手册下载

H3C Workspace云桌面 开局指导书-5W102-整本手册.pdf  (9.58 MB)

(9.58 MB)

H3C Workspace云桌面

开局指导书

资料版本:5W102-20231215

Copyright © 2023 新华三技术有限公司 版权所有,保留一切权利。

非经本公司书面许可,任何单位和个人不得擅自摘抄、复制本文档内容的部分或全部,并不得以任何形式传播。

除新华三技术有限公司的商标外,本手册中出现的其它公司的商标、产品标识及商品名称,由各自权利人拥有。

本文档中的信息可能变动,恕不另行通知。

8.1 H3C Workspace 客户端安装部署(办公场景)

8.2 H3C Learningspace 客户端安装部署(教育场景)

10.7.1 Workspace一体机支持的RAID卡类型确认

10.13 C5570V终端作为低成本教育场景UCC解决方案的管理平台节点

10.16 (仅LSI RAID卡)关闭consistency check和Patrol Read功能

作为一种云计算架构,H3C Workspace将操作系统、数据和终端全部集中到数据中心进行管理。用户可以针对不同的业务场景,灵活配置。H3C Workspace以出色的性能、安全性,极低成本的交付Windows桌面,满足各种业务的需要。

H3C Workspace融合了VDI、IDV、VOI三种不同的桌面架构技术。

· VDI(虚拟桌面基础架构):通过H3C自研的云桌面传输协议VDP,将操作系统界面以图像的方式传送给前端的接入设备,从而让数据更安全、运维更简单。VDI架构下,只要网络可达,用户可以随时随地使用多种形式的终端设备登录云桌面进行办公。

· IDV(智能桌面虚拟化架构):数据中心侧通过管理平台集中化、图形化的界面纳管用户终端设备;远端侧计算资源本地化,充分利用本地终端的计算能力和图形处理能力,以极低的成本提供三维图形处理能力,同时在管理网络不可达的情况下,也能完成日常办公应用,摆脱对网络的强依赖,并且能够最大限度的支持不同的外部设备。

· VOI(虚拟操作系统基础架构):数据中心侧通过管理平台集中化、图形化的界面纳管用户终端设备;远端侧通过虚拟操作系统完全纳管终端底层硬件,完全支持所有终端外设的使用。解决部分对外设种类和数量有强要求场景的使用,同时在管理网络不可达的情况下,能够完成日常办公应用,摆脱对网络的强依赖。

H3C Workspace平台部署分为两种场景,计算虚拟化和超融合架构。其中计算虚拟化场景下,只需部署虚拟化管理平台,无须部署分布式存储,虚拟化平台使用的存储由外部IP SAN或FC SAN存储提供;超融合架构下,需同时部署虚拟化管理平台和分布式存储管理平台,虚拟化平台使用的存储由分布式存储提供,也可以由外部IP SAN或FC SAN存储提供。

· 纯教育场景仅支持计算虚拟化部署。

· 办公场景使用ARM架构服务器仅支持计算虚拟化部署。

· NVME盘只能识别Intel类型,如需支持其它厂商的NVME盘,需联系研发修改配置。

· 若使用NVMe盘作为系统盘,则不支持搭建双机热备,且安装前需手工为硬盘配置RAID(推荐两块NVMe盘配置RAID 1,且需要服务器支持VROC模块),并使用手动安装方式。

表2-1 纯管理服务器配置

|

指标项 |

指标值 |

|

数量 |

≥1台 |

|

CPU |

Intel处理器,主频≥2.0GHz |

|

内存 |

每台服务器主机≥128GB |

|

系统盘 |

每台服务器主机SAS HDD硬盘 600GB*2块,10k rpm,推荐两块硬盘RAID1 |

|

网卡 |

每台服务器主机≥1*4端口千兆以太网卡+1*2端口万兆网卡 |

· CPU必须支持硬件辅助虚拟化技术。X86架构服务器CPU需支持Intel-VT(Intel Virtualization Technology,虚拟化技术)。

· 纯管理服务器仅作为管理节点,不作为业务节点。

· 若两台纯管理节点搭建双机热备,建议两台服务器配置完全一致。

|

指标项 |

指标值 |

|

数量 |

≥1台 |

|

CPU |

Intel至强处理器,主频≥2.2GHz;鲲鹏处理器,主频≥2.6GHz;AMD EPYC处理器,主频≥2.3GHz |

|

内存 |

每台服务器主机≥8*32GB |

|

系统盘 |

每台服务器主机SAS HDD硬盘 600GB*2块,10k rpm,推荐两块硬盘RAID1 |

|

数据盘 |

每台服务器主机SATA SSD硬盘 960GB * 3块,推荐3块硬盘RAID 5 |

|

每台服务器主机SATA HDD硬盘 4TB*2块,≥7.2k rpm,推荐两块硬盘RAID1 |

|

|

网卡 |

每台服务器主机≥1*4端口千兆以太网卡 |

· CPU:必须支持硬件辅助虚拟化技术。X86架构服务器CPU需支持Intel-VT(Intel Virtualization Technology,虚拟化技术)或AMD-V(AMD Virtualization,虚拟化);ARM架构服务器CPU需支持ARM VHE虚拟化扩展技术。采用同一厂商、同一产品族和同一代处理器的服务器组成的集群,可以获得最好的迁移兼容能力。

· 服务器磁盘的安插必须按插槽编号顺序依次为SAS系统盘,SSD数据盘,HDD数据盘,便于RAID制作和管理。

· 若磁盘安插顺序不规范,强烈建议重新安插并重新手动制作RAID。

· 纯VOI办公场景服务器配置请参考小规模VOI管理服务器配置要求、中等规模VOI管理服务器配置要求、大规模VOI管理服务器配置要求。

· 数据盘供VDI云桌面使用。

表2-3 中低配服务器配置要求-intel

|

指标项 |

规格 |

|

适用场景 |

轻载与重载场景,根据虚拟机配置不同,支持20~50点数云桌面 |

|

CPU |

Intel至强处理器4210(2路*10核)及以上,主频≥2.2GHz |

|

内存 |

8*16GB及以上 |

|

系统盘 |

1*600GB HDD及以上,推荐两块硬盘RAID1(仅用于安装系统) |

|

镜像盘 |

1*960GB SSD及以上 |

|

数据盘 |

可按需选配 |

|

网卡 |

集群规模小于5,至少存在4端口千兆以太网口;集群规模大于等于5,至少存在2个万兆以太网口 |

表2-4 高配服务器配置要求-intel

|

指标项 |

规格 |

|

适用场景 |

轻载与重载场景,根据虚拟机配置不同,支持25~60点数云桌面 |

|

CPU |

Intel至强处理器4214R(2路*12核)及以上,主频≥2.4GHz |

|

内存 |

10*16GB及以上 |

|

系统盘 |

1*600GB HDD及以上,推荐两块硬盘RAID1(仅用于安装系统) |

|

镜像盘 |

1*960GB SSD及以上 |

|

数据盘 |

可按需选配 |

|

网卡 |

集群规模小于5,至少存在4端口千兆以太网口;集群规模大于等于5,至少存在2个万兆以太网口 |

表2-5 高配服务器配置要求-AMD

|

指标项 |

规格 |

|

适用场景 |

轻载与重载场景,根据虚拟机配置不同,支持30~60点数云桌面 |

|

CPU |

AMD EPYC 7352(2路*24核)及以上,主频≥2.3GHz |

|

内存 |

10*16GB及以上 |

|

系统盘 |

2*600GB HDD及以上,推荐两块硬盘组RAID1(仅用于安装系统) |

|

镜像盘 |

2*480GB SSD及以上,推荐作RAID0 |

|

数据盘 |

可按需选配 |

|

网卡 |

集群规模小于5,至少存在4端口千兆以太网口;集群规模大于等于5,至少存在2个万兆以太网口 |

表2-6 超高配服务器配置要求-AMD

|

指标项 |

规格 |

|

适用场景 |

轻载与重载场景,根据虚拟机配置不同,支持55~120点数云桌面 |

|

CPU |

AMD EPYC 7502(2路*32核)及以上,主频≥2.5GHz |

|

内存 |

10*32GB及以上 |

|

系统盘 |

2*600GB HDD及以上,推荐两块硬盘组RAID1(仅用于安装系统) |

|

镜像盘 |

4*480GB SSD及以上,推荐作RAID0 |

|

数据盘 |

可按需选配 |

|

网卡 |

集群规模小于5,至少存在4端口千兆以太网口;集群规模大于等于5,至少存在2个万兆以太网口 |

表2-7 小规模VOI管理服务器配置要求

|

指标项 |

规格 |

|

适用场景 |

重载场景,根据VOI终端配置不同,支持120点以下桌面数 |

|

CPU |

I5-9400及以上 主频≥2.9GHz |

|

内存 |

32GB及以上 |

|

系统盘 |

512GB SSD及以上,推荐两块硬盘组RAID1 |

|

网卡 |

至少存在1千兆以太网口 |

表2-8 中等规模VOI管理服务器配置要求

|

指标项 |

规格 |

|

适用场景 |

重载场景,根据VOI终端配置不同,支持120~1000点桌面数 |

|

CPU |

Intel至强处理器3260R(2路*8核)及以上,主频≥1.9GHz |

|

内存 |

64GB及以上 |

|

系统盘 |

1*600GB HDD及以上,推荐两块硬盘RAID1(仅用于安装系统) |

|

镜像盘 |

1*480GB SSD及以上 |

|

数据盘 |

可按需选配 |

|

网卡 |

桌面数200点以下,至少存在4端口千兆以太网口;桌面数200点以上,至少存在2个万兆以太网口 |

表2-9 大规模VOI管理服务器配置要求

|

指标项 |

规格 |

|

适用场景 |

重载场景,根据VOI终端配置不同,支持1000~2000点桌面数 |

|

CPU |

Intel至强处理器4208(2路*8核)及以上,主频≥2.1GHz |

|

内存 |

128GB及以上 |

|

系统盘 |

1*600GB HDD及以上,推荐两块硬盘RAID1(仅用于安装系统) |

|

镜像盘 |

1*480GB SSD及以上 |

|

数据盘 |

可按需选配 |

|

网卡 |

至少存在4端口千兆以太网口,至少存在2个万兆以太网口 |

表2-10 低配服务器配置要求-intel

|

指标项 |

规格 |

|

适用场景 |

轻载与中载场景,根据虚拟机配置不同,支持25~40点数云桌面 |

|

CPU |

Intel至强处理器4214R(2路*12核)及以上,主频≥2.4GHz |

|

内存 |

桌面内存*桌面数*120%(安全空间)+32GB(管理平台) |

|

系统盘 |

2*600GB HDD及以上,推荐两块硬盘组RAID1(仅用于安装系统) |

|

镜像盘 |

2*480GB SSD及以上,推荐作RAID0 |

|

数据盘 |

可按需选配 |

|

网卡 |

集群规模小于4,至少存在4端口千兆以太网口;集群规模大于等于4,至少存在2个万兆以太网口 |

表2-11 中配服务器配置要求-intel

|

指标项 |

规格 |

|

适用场景 |

轻载、中载与重载场景,根据虚拟机配置不同,支持30~50点数云桌面 |

|

CPU |

Intel至强处理器5218(2路*16核)及以上,主频≥2.3GHz |

|

内存 |

桌面内存*桌面数*120%(安全空间)+32GB(管理平台) |

|

系统盘 |

2*600GB HDD及以上,推荐两块硬盘组RAID1(仅用于安装系统) |

|

镜像盘 |

2*480GB SSD及以上,推荐作RAID0 |

|

数据盘 |

可按需选配 |

|

网卡 |

集群规模小于4,至少存在4端口千兆以太网口;集群规模大于等于4,至少存在2个万兆以太网口 |

表2-12 高配服务器配置要求-Intel

|

指标项 |

规格 |

|

适用场景 |

轻载、中载与重载场景,根据虚拟机配置不同,支持40~60点数云桌面 |

|

CPU |

Intel至强处理器6226R(2路*16核)及以上,主频≥2.9GHz |

|

内存 |

桌面内存*桌面数*120%(安全空间)+32GB(管理平台) |

|

系统盘 |

2*600GB HDD及以上,推荐两块硬盘组RAID1(仅用于安装系统) |

|

镜像盘 |

2*480GB SSD及以上,推荐作RAID0 |

|

数据盘 |

可按需选配 |

|

网卡 |

集群规模小于4,至少存在4端口千兆以太网口;集群规模大于等于4,至少存在2个万兆以太网口 |

表2-13 高配服务器配置要求-AMD

|

指标项 |

规格 |

|

适用场景 |

轻载、中载与重载场景,根据虚拟机配置不同,支持40~60点数云桌面 |

|

CPU |

AMD EPYC 7502(2路*32核)及以上,主频≥2.5GHz |

|

内存 |

桌面内存*桌面数*120%(安全空间)+32GB(管理平台) |

|

系统盘 |

2*600GB HDD及以上,推荐两块硬盘组RAID1(仅用于安装系统) |

|

镜像盘 |

2*480GB SSD及以上,推荐作RAID0 |

|

数据盘 |

可按需选配 |

|

网卡 |

集群规模小于4,至少存在4端口千兆以太网口;集群规模大于等于4,至少存在2个万兆以太网口 |

表2-14 GPU服务器(不渲染)配置要求

|

指标项 |

规格 |

|

适用场景 |

最大桌面数(不做渲染)32 |

|

CPU |

Intel至强处理器6226R(2路*16核)及以上,主频≥2.9GHz |

|

内存 |

12*32GB |

|

GPU |

请参考《H3C Workspace云桌面 vGPU配置指导》 |

|

系统盘 |

1*600GB HDD及以上,推荐两块硬盘RAID1(仅用于安装系统) |

|

镜像盘 |

1*480GB SSD及以上 |

|

数据盘 |

可按需选配 |

|

网卡 |

集群规模小于4,至少存在4端口千兆以太网口;集群规模大于等于4,至少存在2个万兆以太网口 |

表2-15 GPU服务器(渲染)配置要求

|

指标项 |

规格 |

|

适用场景 |

最大桌面数(做渲染)16~24,以GPU显存分配数量为上限 |

|

CPU |

Intel至强处理器6246R(2路*16核)及以上,主频≥3.4GHz |

|

内存 |

12*32 GB或16*32GB,单卡16~24GB显存 |

|

GPU |

请参考《H3C Workspace云桌面 vGPU配置指导》 |

|

系统盘 |

1*600GB HDD及以上,推荐两块硬盘RAID1(仅用于安装系统) |

|

镜像盘 |

1*480GB SSD及以上 |

|

数据盘 |

可按需选配 |

|

网卡 |

集群规模小于4,至少存在4端口千兆以太网口;集群规模大于等于4,至少存在2个万兆以太网口 |

· 服务器CPU必须支持Intel-VT或AMD-V。采用同一厂商、同一产品族和同一代处理器的服务器组成的集群,可以获得最好的迁移兼容能力。

· Intel-VT(Intel Virtualization Technology,虚拟化技术):使用这种技术就可以单CPU模拟多CPU并行,可以实现单机同时运行多操作系统。

· AMD-V(AMD Virtualization,虚拟化):把一台主机在逻辑上分割成几个虚拟机,每个虚拟机均分配有独立的硬件资源,从而在各自的虚拟机上能够分别独立运行各自操作系统,从而实现在一台主机上同时运行不同操作系统。

· 内存:内存资源往往比CPU资源更会成为潜在的性能瓶颈,尽可能将服务器配置到最大内存,采用最大容量的内存条。

· 电源:建议配置双冗余电源以尽量避免服务器电源本身的故障造成虚拟机业务中断。

· 要求部署桌面的业务服务器配置相同。

· C5570V终端作为UCC终端的教育管理节点的安装方法及使用限制请参见C5570V终端作为低成本教育场景UCC解决方案的管理平台节点。

· 教育场景下,若需部署VDI课程,则需要配置数据盘。

H3C Workspace产品一体机服务器主推H3C UIS-Desktop-50(CPU 5218系列)和H3C UIS-Desktop-40 (CPU 4214系列)两款服务器,详细硬件配置如下:

表2-16 超融合场景H3C UIS-Desktop-50 配置

|

指标项 |

指标值 |

|

数量 |

≥3台 |

|

CPU |

Intel至强处理器,主频≥2.3GHz |

|

内存 |

每台服务器主机 ≥10*32GB |

|

系统盘 |

每台服务器主机SAS HDD硬盘 600GB*2块; 10k rpm; 推荐两块硬盘组RAID1 |

|

数据盘 |

每台服务器主机SATA SSD硬盘≥480GB*2块;单独每块硬盘作RAID 0 |

|

每台服务器主机SATA HDD硬盘≥2TB*8块;≥7.2k rpm; 单独每块硬盘作RAID0 |

|

|

网卡 |

≥1*4端口千兆以太网卡+1*2端口万兆网卡 |

表2-17 超融合场景H3C UIS-Desktop-40配置

|

指标项 |

指标值 |

|

数量 |

≥3台 |

|

CPU |

Intel至强处理器,主频≥2.2GHz |

|

内存 |

每台服务器主机 ≥8*32GB |

|

系统盘 |

每台服务器主机SAS HDD硬盘 ≥600GB*2块; 10k rpm; 推荐两块硬盘组RAID1 |

|

数据盘 |

每台服务器主机SATA SSD硬盘≥480GB*1块;单独每块硬盘作RAID 0 |

|

每台服务器主机SATA HDD硬盘≥4TB*4块;≥7.2k rpm; 单独每块硬盘作RAID0 |

|

|

网卡 |

≥1*4端口千兆以太网卡+1*2端口万兆网卡 |

· CPU必须支持硬件辅助虚拟化技术,如Intel-VT。采用同一厂商、同一产品族和同一代处理器的服务器组成的集群,可以获得最好的迁移兼容能力。

· 内存:内存资源往往比CPU资源更会成为潜在的性能瓶颈,尽可能将服务器配置到最大内存,采用最大容量的内存条。

· 网卡:管理网和业务网网卡建议使用千兆或万兆网卡,存储网使用万兆网卡,建议使用链路聚合方式,提高链路的高吞吐量和高可靠性。

· 本地磁盘:无外接存储时,本地磁盘大小与虚拟机的数量及给其分配的磁盘大小有关。有外接存储时,本地磁盘用于保存虚拟机配置文件等信息。建议配置至少2块SAS或SATA磁盘,并配置RAID 1。

· 电源:建议配置双冗余电源以尽量避免服务器电源本身的故障造成虚拟机业务中断。

· 磁盘的安插必须按插槽编号由小到大顺序依次为SAS系统盘,SSD数据盘,HDD数据盘;以方便RAID制作和管理;若磁盘安插顺序不规范,强烈建议重新安插并重新手动制作RAID。

· 建议超融合存储节点使用同一型号RAID卡。

提前准备H3C Workspace管理平台软件安装包,根据实际情况选择对应安装包进行安装。

表2-18 Workspace管理平台软件包

|

软件包名称 |

说明备注 |

|

H3C_WORKSPACE-version-x86_64-AUTO.iso |

x86架构服务器安装包,安装过程中可选择自动安装或者手动安装(默认自动安装) |

|

H3C_WORKSPACE-version-aarch64-AUTO.iso |

ARM架构服务器安装包,安装过程中可选择自动安装或者手动安装(默认自动安装) |

|

H3C_Workspace-version -Clients.tar.gz |

客户端安装包集 |

|

H3C_SpaceOS-version.zip |

SpaceOS安装包集 |

|

H3C_Workspace-version-OptTools.zip |

优化工具安装包 |

|

H3C_Space-Center-version.tar.gz |

x86架构Space Center安装包 |

|

H3C_Workspace_Gateway_Solution-version -x86_64.tar.gz |

x86架构网关安装包 |

|

H3C_Workspace_Gateway_Solution-version–aarch64.tar.gz |

ARM架构网关安装包 |

|

Viewscreen2.0-installer.tar.gz |

x86架构Learningspace监管平台安装包 |

|

H3Linux_K414_V112.iso |

x86架构网关及Learningspace监管平台底层系统安装包 |

|

H3Linux_K414_V112_ARM |

arm架构网关及Learningspace监管平台底层系统安装包 |

|

H3C_labmgt-version.tar.gz |

x86架构Learningspace排课系统安装包 |

· 手动安装:主要用于计算虚拟化场景以及其他特殊要求场景,可修改系统安装时默认分区,例如RAID特殊要求或系统盘分区特殊要求。版本安装时,可根据实际规划手动完成相关配置。

· 非一体机超融合架构部署场景,若使用自动安装,请先清除原有RAID配置。

· 非一体机计算虚拟化部署场景,若使用自动安装,请先手动完成RAID制作。

· 英文国际化版本仅支持手动安装。

H3C Workspace配套多款云终端,如C113S、C101LS、C103V、C105V等,具体请参见产品配套版本说明书。

H3C Learningspace配套多款云终端作为学生端,如C113L、C200V、C206V等,具体请参见产品配套版本说明书。

· 请确保实施时所用的SpaceOS系统终端(如C113、C101LS)的SpaceOS版本与当前部署的Space Console管理平台版本保持一致。若不一致,请升级终端SpaceOS系统,具体操作可参见表2-20《H3C Workspace云桌面升级指南》版本升级操作指导章节。

· H3C Learningspace教师端使用个人PC或高性能终端,教师端操作系统推荐Windows 10 1909企业版,intel 6代及以下CPU的设备 ,可使用Windows 7 sp1 企业版。

H3C Workspace 产品开局需要提前准备虚拟机操作系统ISO以及License Server ISO镜像文件,具体推荐版本如下。

表2-19 推荐虚拟机操作系统

|

操作系统 |

具体版本 |

备注 |

|

Windows 7 |

Windows 7 Enterprise with Service Pack 1 |

推荐使用64位版本&企业版(内存配置小于4G推荐使用32位版本) |

|

Windows 10 |

Windows 10 (business editions),version 1909 |

推荐使用64位版本&企业版(内存配置小于4G推荐使用32位版本) |

|

中科方德 |

NFSDesktop-4.0-G006-20211018.01-amd64-JRXC |

桌面操作系统 |

|

银河麒麟Kylin |

ARM架构服务器:Kylin-Desktop-V10-SP1-Release-2107-arm64.iso X86架构服务器:Kylin-Desktop-V10-SP1-Release-2107-x86_64.iso |

桌面操作系统 |

|

UOS |

ARM架构服务器:uniontechos-desktop-20-professional-1050-arm64 X86架构服务器:uniontechos-desktop-20-professional-1050-amd64 |

桌面操作系统 |

|

H3Linux |

H3C License Server E1205或H3C License Server E1145 |

Workspace License Server |

Windows系统正版授权需要另行获取。

|

文档名称 |

备注 |

|

《H3C Workspace云桌面 安装部署指导》 |

可在H3C官方网站文档中心获取,参见:https://www.h3c.com/cn/Service/Document_Software/Document_Center/H3Cloud/Catalog/H3C_Cloud_YZM/H3C_Workspace/ |

|

《H3C Workspace云桌面 业务快速部署(办公场景)》 |

|

|

《H3C Workspace云桌面 快速入门(教育场景)》 |

|

|

《H3C Workspace云桌面 分布式存储配置指导》 |

|

|

《H3C Workspace云桌面License支持情况说明》 |

|

|

《H3C 软件产品远程授权 License使用指南》 |

|

|

《H3C ONEStor分布式存储产品 License使用指南》 |

可在H3C官方网站文档中心获取,参见:https://www.h3c.com/cn/Service/Document_Software/Document_Center/Storage/Catalog/H3C_ONEStor/H3C_ONEStor3.0/?CHID=288661&v=612 |

|

《H3C Workspace云桌面-version-版本说明书》 |

随软件版本发布,version代表具体的版本号 |

|

《H3C Workspace云桌面升级指南》 |

|

|

《H3C Workspace云桌面 对外测试手册》 |

可选,需要详细验证功能时联系H3C技术工程师获取 |

H3C Workspace 支持x86架构服务器计算虚拟化和超融合架构两种部署场景,arm架构服务器计算虚拟化部署,用户可以根据业务需求和应用场景灵活选择。

H3C Learningspace支持x86架构服务器计算虚拟化部署,包括管理节点与业务节点融合部署和分离部署场景,典型部署方案有两种:单机部署和集群部署。用户可以根据业务需求和应用场景灵活选择。

计算虚拟化适用于使用服务器本地磁盘或者共享存储(IP SAN/FC SAN)作为存储池的场景。计算虚拟化模式初始化时需要进行网络配置、添加主机等操作。管理平台初始化完成后,需要手动添加本地磁盘或者共享存储作为存储池,用于存放虚拟机镜像文件。

计算虚拟化场景下,服务器有管理节点和业务节点两种角色。

· 管理节点:提供管理、运维整个系统的Web用户页面。初始化部署前用户需指定一台服务器作为管理节点并为该服务器配置管理IP地址。

· 业务节点:提供计算业务的节点。

计算虚拟化场景支持融合部署和分离部署两种方案。

· 融合部署:管理节点同时作为业务节点。

· 分离部署:管理节点不作为业务节点。

服务器数量为N时,推荐采用如表3-1所示的部署方案:

|

服务器数量 |

推荐部署方案 |

|

1≤N<16 |

融合部署 |

|

N≥16 |

分离部署 |

超融合架构适用于使用分布式存储(ONEStor)作为存储池的场景。超融合架构部署必须搭建双机热备。超融合架构模式初始化时需要进行网络配置、添加主机、配置存储等操作。H3C Workspace融合了H3C ONEStor分布式存储产品,选择超融合架构初始化过程中需要配置分布式存储,初始化成功后即可使用分布式存储作为存储池,用于存放虚拟机镜像文件。

超融合架构场景下,服务器有管理节点、业务节点、存储节点、监控节点四种角色。

· 管理节点:提供管理、运维整个超融合系统的Web用户页面。初始化部署前用户需指定一台服务器作为管理节点并为该服务器配置管理IP地址。

· 业务节点:提供计算、存储业务的节点。

· 存储节点:提供数据存储服务。超融合场景下最小部署两个节点,推荐部署3个以上。两节点部署方案请参考《H3C Workspace云桌面 两节点部署指导》。

· 监控节点:维护整个存储系统的全局状态,持有整个存储系统的元数据信息。监控节点数量最小为3,最大为7,且必须为奇数。当存储节点数量为N时,推荐监控节点的数量如下:

¡ 3≤N≤4时,推荐设置3个监控节点。

¡ 5≤N≤10,推荐设置5个监控节点。

¡ N≥11时,推荐设置7个监控节点。

超融合架构场景支持融合部署和分离部署两种方案。

· 融合部署:管理节点同时作为业务节点。

· 分离部署:管理节点不作为业务节点。

服务器数量为N时,推荐采用如表3-2所示的部署方案:

|

服务器数量 |

推荐部署方案 |

|

3≤N<16 |

融合部署 |

|

N≥16 |

分离部署 |

一台服务器可以同时承担管理节点和业务节点两种角色;超融合架构场景下包含分布式存储,分布式存储中业务节点又分为存储节点和监控节点,一台服务器也可以同时作为存储节点和监控节点。

服务器的CPU资源主要用于底层虚拟化系统及Workspace管理软件和业务虚拟机使用,推荐分配参考如下表。

表3-3 CPU分配参考

|

CPU用途 |

推荐分配 |

说明 |

|

系统服务 |

20% |

用于底层虚拟化系统、Workspace管理软件 |

|

业务虚拟机 |

80% |

用于用户虚拟机系统 |

表3-4 业务虚拟机的CPU规划与适用场景

|

CPU规划 |

适用场景 |

说明 |

|

单台虚拟机分配2核 |

轻载 |

轻载主要指office办公、浏览网页、访问OA系统等场景 |

|

单台虚拟机分配4核 |

中载 |

中载主要指轻量3D应用、播放视频等场景 |

|

单台虚拟机分配8核或更多 |

重载 |

重载主要指重型3D应用、软件开发、美工设计等场景 |

单台一体机服务器性能套餐配置可参照Workspace配置推荐手册;由于不同软件对虚拟机CPU资源消耗不尽相同,实际部署时应根据应用场景做相应调整。

服务器的内存资源主要用于底层虚拟化系统及Workspace管理软件和业务虚拟机使用,推荐分配参考如下表。

表3-5 管理节点内存分配参考

|

内存用途 |

推荐分配 |

说明 |

|

系统服务 |

30% |

用于底层虚拟化系统、Workspace管理软件 |

|

业务虚拟机 |

70% |

用于用户虚拟机系统 |

表3-6 业务节点内存分配参考

|

内存用途 |

推荐分配 |

说明 |

|

系统服务 |

20% |

用于底层虚拟化系统、Workspace管理软件 |

|

业务虚拟机 |

80% |

用于用户虚拟机系统 |

表3-7 业务虚拟机的内存规划与适用场景

|

内存规划 |

适用场景 |

说明 |

|

单台虚拟机分配4GB |

轻/中载 |

轻/中载主要指office办公、浏览网页、访问OA系统、视频重定向等场景 |

|

单台虚拟机分配8GB或更多 |

重载 |

重载主要指3D应用、软件开发、美工设计、非视频重定向等场景 |

请勿超分配内存,因为虚拟机运行后就会直接占用分配的内存,而不是使用多少占用多少。

H3C Workspace支持使用本地磁盘、共享存储、分布式存储作为存储池。计算虚拟化场景下通常使用本地磁盘或共享存储作为存储池;超融合架构场景下使用分布式存储作为存储池。

· 由于HDD硬盘受限于磁盘转速等本身机械性,因此不推荐使用HDD盘来存储虚拟机系统盘镜像。若使用HDD盘存储虚拟机系统盘镜像,大量虚拟桌面在短时间内同时启动,容易造成启动风暴,降低用户体验。若用户成本受限,只能使用HDD盘,也可以配置桌面池或虚拟机的定时开机任务,使虚拟机错峰开机,以避免启动风暴的产生。桌面池或虚拟机定时任务的详细配置方法,请参见启动风暴解决方案。

· 系统盘最低要求480GB,若本地存储/vms需求大(如tmp目录数据存放以及双机热备场景等)的情况下推荐600GB。

在H3C Workspace解决方案中存在两种部署场景。

计算虚拟化场景下,配置有RAID卡的服务器,请首先确保服务器未配置RAID,若已存在RAID配置请手动清除,然后手动配置本地磁盘RAID和手动挂载磁盘,磁盘RAID配置类型参考下表,手动挂载磁盘方法参考本地磁盘挂载指导一节。

表3-8 计算虚拟化场景RAID配置

|

磁盘类型 |

磁盘指标 |

RAID类型 |

说明 |

|

SAS HDD |

600GB*2块,10k rpm |

RAID1 |

Workspace系统安装 |

|

SATA SSD |

960GB*3块 |

RAID5 |

需要手动挂载,用于虚拟机系统盘镜像存储 |

|

SATA HDD |

4TB*2块,≥7.2k rpm |

RAID1 |

需要手动挂载,用于虚拟机数据盘镜像存储 |

计算虚拟化场景下,配置有RAID卡的服务器,请首先确保服务器未配置RAID,若已存在RAID配置请手动清除,然后手动配置本地磁盘RAID和手动挂载磁盘,磁盘RAID配置类型参考下表,手动挂载磁盘方法参考本地磁盘挂载指导一节。

|

磁盘类型 |

磁盘指标 |

RAID类型 |

说明 |

|

SAS HDD |

600GB*2块,10k rpm |

RAID1 |

Learningspace系统安装 |

|

SATA SSD |

480GB*1块 |

RAID0 |

用于教学镜像存储(无需手动后台挂载) |

|

SATA HDD |

可按需选配 |

RAID0 |

需要手动挂载,用于云盘、校园空间等存储 |

超融合场景下,请首先确保服务器未配置RAID,若已存在RAID配置请手动清除;然后使用自动安装会自动完成RAID配置和系统安装。

· 若服务器为LSI 9440 raid卡,则数据盘需要使用Jbod模式,而非RAID0,系统盘仍为RAID1。

· 若缓存盘使用读密集型SSD,则磁盘容量必须为960G及以上。

· 缓存分区大小必须为150GB及以上,推荐300GB及以上。

表3-10 超融合场景RAID配置

|

磁盘类型 |

磁盘指标 |

RAID类型 |

用途说明 |

|

SAS HDD |

600GB*2块,10k rpm |

RAID1 |

Workspace系统安装 |

|

SATA SSD |

960GB*2块 |

每块磁盘分别做RAID0 |

OneStor缓存加速模式下的缓存盘 |

|

SATA HDD |

2TB*8块/4TB*4块,≥7.2k rpm |

每块磁盘分别做RAID0 |

业务虚拟机存储; H3C Workspace超融合一体机有两种硬件配置,因此超融合一体机数据盘数量及大小也有两种配置。 |

H3C Workspace支持外挂的共享存储,包括IP SAN 或FC SAN存储设备。

· 连接外置IP SAN存储时,主机作为iSCSI Initiator与存储卷的Target完成连接。当主机完成系统安装和初始化部署后,系统会自动生成一个iQN标识符,主机使用此标识符与Target建立连接。

· 连接外置FC SAN存储时,主机需要配置FC HBA卡。

· IP SAN或FC SAN上创建的存储卷在主机上有多种挂载方式,推荐使用共享文件系统的方式挂载存储卷,为上层虚拟化业务提供共享存储的服务。

· 一个iSCSI/FC共享文件系统最大可以被一个集群下的32台主机同时使用。

· 一个iSCSI/FC共享文件系统最大支持32TB的存储卷,建议使用10TB~32TB的存储卷。

· 服务器的Initiator信息需要保证唯一性,否则会导致共享文件系统异常。

· 推荐划分多个LUN挂载给主机使用,虚拟机系统盘和数据盘存放在不同的LUN中。

· 用户有虚拟机故障迁移的需求时,必须将虚拟机模板放到共享存储内,且确保所有cvk主机都可以访问该共享存储。

· 虚拟机磁盘缓存模式为writethrough时,单个共享存储卷,建议部署不超过30台链接克隆虚拟机或50台完全克隆虚拟机。

用户有云桌面故障迁移的需求时,必须确保HA打开且将桌面镜像放到共享存储内,且确保所有CVK主机都可以访问该共享存储。

H3C Workspace分布式存储支持四种部署方式,包括闪存加速、全SSD、全HDD和快慢池,推荐使用闪存加速,管理平台初始化完成后就可以直接使用分布式存储。

· 闪存加速:数据盘使用HDD盘,读/写缓存加速盘使用SSD盘。闪存加速为较常用方式,加速盘配置方法参考SSD加速盘规划。

· 全SSD:数据盘使用SSD盘,无读/写缓存加速盘,提供高性能的存储服务。用户成本允许的情况下,推荐使用该方式部署,以获取较高的数据读写速度,也能避免大量虚拟桌面短时间同时开机造成的启动风暴。

· 全HDD:数据盘使用HDD盘,无读/写缓存加速盘,提供普通存储服务。HDD虽然价格相对较低,但由于本身机械属性,其数据读写速度相对于SSD慢。因此,在大量虚拟桌面短时间同时开机的情况下,容易造成启动风暴。使用该方式部署时,为避免启动风暴,可对桌面池或虚拟机配置定时启动任务,实现错峰开机从而避免启动风暴的产生,具体操作请参见启动风暴解决方案。

· 快慢池:数据盘使用SSD和HDD盘,SSD盘被划分到快池,HDD盘被划分到慢池,快池用来提供高性能服务,慢池用来提供普通存储服务;快池用于存放虚拟机系统盘,慢池用于存放虚拟机数据盘。

闪存加速为较常用方式配置缓存加速时比例要求,请注意:

若服务器配置的是SATA SSD,则要求每台服务器的SSD硬盘个数:HDD硬盘个数≥1:5;若服务器配置的是NVMe SSD,则要求每台服务器的SSD硬盘个数:HDD硬盘个数≥1:10。例如:某台服务器上,SSD硬盘的个数只有1个,而HDD硬盘的个数有15个。此时,禁止开启缓存加速。

· 对带宽要求较高的场景,受限于SSD的接口带宽,当SSD硬盘个数:HDD硬盘个数<1:5时,软件允许部署,开启缓存加速可能不仅起不到加速效果,SSD盘压力过大会降低分布式存储集群的整体性能,严重时会导致集群存储服务异常。

· 必须关闭所有节点硬盘缓存,确认及关闭方法详见硬盘缓存设置。

· 分布式存储集群一个SSD缓存分区分配给一个HDD硬盘使用。

· 在SSD缓存空间足够的情况下,建议尽可能的增大缓存分区的大小。

· 在SSD空间容量足够的情况下,使用SSD实际总容量/HDD磁盘个数,即为每个缓存分区空间大小。例如,某存储节点有10块HHD数据盘,2块SSD缓存盘,SSD缓存盘实际空间为960GB,在不考虑后续扩容HDD磁盘的情况下,可以配置缓存分区大小为960GB/5≈192GB。

· 配置容量时,请注意保证:缓存容量 * 数据盘数 < SSD容量。

· 不支持在线修改缓存配置,建议提前规划部署。

· 若缓存盘使用读密集型SSD,则磁盘容量必须为960G及以上。

· 缓存分区大小必须为150GB及以上,推荐300GB及以上。

部分服务器硬盘写缓存默认开启,为保证服务器异常掉电恢复后集群数据的一致性,硬盘缓存必须关闭。为确保硬盘写缓存都能有效关闭,要求服务器的所有硬盘都必须做RAID。但LSI 9440 raid卡除外,LSI 9440 raid卡数据盘需要使用Jbod,系统盘要求为RAID1。

硬盘和RAID卡缓存配置如表3-11所示,硬盘缓存设置方法请参见硬盘缓存设置。

|

类型 |

SSD系统盘 |

HDD系统盘 |

SSD加速盘 |

HDD数据盘 |

SSD数据盘 |

|

阵列硬盘缓存 |

关闭 |

关闭 |

关闭 |

关闭 |

关闭 |

|

RAID卡读缓存 |

关闭 |

关闭 |

关闭 |

关闭 |

关闭 |

|

RAID卡写缓存 |

关闭 |

打开 |

关闭 |

打开 |

关闭 |

副本是将原始数据复制多份,每一份称为一个副本,副本存放在不同存储节点的不同磁盘上。当磁盘出现故障时,只要其余健康磁盘中任一个磁盘拥有副本,用户就可以获取该数据。副本个数越多,安全性越高,但存储数据所需空间也成倍增长。

系统存储节点数量与可设置的副本关系如表3-12所示:

|

存储节点数量 |

可设置的副本数 |

|

3 |

2,3 |

|

4 |

2,3,4 |

|

5 |

2,3,4,5 |

|

≥6 |

2,3,4,5 |

· H3C UIS-Desktop-40 G3系列一体机推荐2副本。

· H3C UIS-Desktop-50 G3系列一体机推荐3副本。

· 推荐3副本,实际副本数需按需要配置。磁盘可用空间计算方式:可用磁盘空间等于总磁盘空间除以副本数,副本数和可靠性关系参考副本数和可靠性关系

搭建超融合架构时,需要规划机架的数量以及不同服务器所处的机架位置。

· 建议按照服务器的实际物理摆放规划和创建机架,尽量不要一个机架上只有一个存储节点。

· 单个机架上存储节点数量不能超过10个。

故障域是分布式存储中数据分布的最小单元。存储数据时,一份数据的不同副本或分片会被分布存储在不同的故障域内,根据冗余策略的配置,允许一定数量的故障域故障而不丢失数据,从而提高数据存储的可靠性。故障域类型有“机架”和“主机”两种:

· “机架”故障域:集群内每个机架为一个故障域,一份数据的不同副本或分片分布存储在不同的机架中。推荐集群规模较大、机架较多的情况下选择此类型。

· “主机”故障域:集群内每台主机为一个故障域,一份数据的不同副本或分片分布存储在不同的主机中(可在同一个机架中)。

部分RAID卡默认开启consistency check和Patrol Read功能,为保证存储性能,建议关闭RAID卡的consistency check和Patrol Read功能,关闭方法请参见(仅LSI RAID卡)关闭consistency check和Patrol Read功能。

部署时推荐采用三网隔离的方式规划网络,分为管理网、业务网、存储网。对于带宽占用多及业务可用性要求高的场景,建议配置链路聚合。

计算虚拟化场景下,集群存在三个网络平面:管理网络、业务网络、存储网络(IP SAN/FC SAN)。

表3-13 计算虚拟化集群的网络定义

|

逻辑网络 |

描述 |

要求 |

|

管理网络 |

用户可以通过管理网络访问集群,对主机节点进行管理和维护。 |

双千兆或万兆网络 |

|

存储网络 |

IP/FC SAN,虚拟机及其应用的IO业务通过存储网络与外部IP/FC存储设备进行通信。 |

万兆网络/FC网络 |

|

业务网络 |

集群对外提供业务的网络。 |

千兆或万兆网络 |

因管理网络、存储网络、业务网络三张网络需要相互独立,使用外置IP SAN存储时,至少需要3个网络端口;使用FC SAN存储时,至少需要2个网络端口。建议各逻辑网络均配置链路聚合。

融合部署方案的网络拓扑示意图如下所示:

图3-1 办公融合部署方案-逻辑网络拓扑

分离部署方案的逻辑网络拓扑示意图如下所示:

图3-2 办公分离部署方案-逻辑网络拓扑

· 以上部署拓扑为建议拓扑,请根据实际生产环境网络拓扑及服务器数量进行调整。

· 管理网和业务网建议分离部署,承载在不同的物理网口上。

· 计算虚拟化场景中需提前规划管理网IP地址,该IP地址需要是管理PC可访问的IP地址。

· 终端用户若是DHCP获取IP,建议接入的交换机端口配置stp边缘端口,配置方法可参考交换机生成树边缘端口开启方法。

· 若终端与管理平台是二层网络互通则终端会自动发现管理平台,如果是三层网络互通则需要手动配置平台地址。

融合部署方案的网络拓扑示意图如下所示:

图3-3 教学融合部署方案-逻辑网络拓扑

分离部署方案的逻辑网络拓扑示意图如下所示:

图3-4 教学分离部署方案-逻辑网络拓扑

· 以上部署拓扑为建议拓扑,请根据实际生产环境网络拓扑及服务器数量进行调整。

· 管理网和业务网建议分离部署,承载在不同的物理网口上。

· 计算虚拟化场景中需提前规划管理网IP地址,该IP地址需要是管理PC可访问的IP地址。

· 终端用户若是DHCP获取IP,建议接入的交换机端口配置stp边缘端口,配置方法可参考交换机生成树边缘端口开启方法。

· 若终端与管理平台是二层网络互通则终端会自动发现管理平台,如果是三层网络互通则需要手动配置平台地址。

计算虚拟化场景中规划以下3个网络,其中IP SAN或FC SAN存储根据实际需要进行规划。

表3-14 网络规划示例

|

逻辑网络 |

IP地址 |

网关 |

VLAN ID |

|

iLO管理网络 |

192.168.1.0/24 |

192.168.1.254 |

10 |

|

管理网络 |

172.20.1.0/24 |

172.20.1.254 |

11 |

|

IP SAN存储网络 |

10.10.11.0/24 |

10.10.11.254 |

12 |

|

业务网络 |

192.170.1.0/24 |

192.170.1.254 |

13 |

表3-15 IP规划示例

|

主机节点 |

iLO网卡(VLAN10) |

管理网卡(VLAN11) |

IP SAN存储网卡(VLAN12) |

业务网卡(VLAN13) |

|

双机管理虚IP |

|

172.20.1.2 |

|

|

|

管理节点#1 |

192.168.1.3 |

172.20.1.3 |

10.10.11.3 |

不配置IP |

|

管理节点#2 |

192.168.1.4 |

172.20.1.4 |

10.10.11.4 |

不配置IP |

|

业务节点#1 |

192.168.1.5 |

172.20.1.5 |

10.10.11.5 |

不配置IP |

|

业务节点#2 |

192.168.1.6 |

172.20.1.6 |

10.10.11.6 |

不配置IP |

|

业务节点#3 |

192.168.1.7 |

172.20.1.7 |

10.10.11.7 |

不配置IP |

由于Workspace产品docker服务器会默认占用172.17.0.0/16网段,所以网络规划需要避开该网段,以防引起冲突,部署失败。若无法避开该网段,请参考Docker服务器网段修改方法进行修改。

超融合架构场景下,集群存在四个网络平面:管理网络、业务网络、存储外网、存储内网。

表3-16 超融合架构集群的网络定义

|

逻辑网络 |

描述 |

要求 |

|

管理网络 |

用户可以通过管理网络访问超融合架构集群,对主机节点进行管理和维护。 |

双千兆或万兆网络 |

|

业务网络 |

超融合架构集群对外提供业务的网络。 |

千兆或万兆网络 |

|

存储外网 |

虚拟机及其应用的IO业务通过存储外网与分布式存储集群进行通信。 |

万兆网络 |

|

存储内网 |

分布式存储集群内部的节点通过存储内网相互通信,用于数据平衡、恢复等,并不对外提供服务。 |

万兆网络 |

融合部署方案的逻辑网络拓扑示意图如下所示:

图3-5 融合部署方案-逻辑网络拓扑

分离部署方案的逻辑网络拓扑示意图如下所示:

图3-6 分离部署方案-逻辑网络拓扑

服务器配置不同网卡时,各逻辑网络使用网络端口的推荐配置如表3-17所示:

|

序号 |

服务器网卡配置举例 |

逻辑网络端口配置举例 |

|

方案1 |

· 1*4端口千兆以太网卡 · 2*2端口万兆以太网卡 |

· 管理网络:2个千兆端口,端口聚合 · 业务网络:2个千兆端口,端口聚合 · 存储外网:2个万兆端口,端口聚合 · 存储内网:2个万兆端口,端口聚合 |

|

方案2 |

· 1*4端口千兆以太网卡 · 1*2端口万兆以太网卡 |

· 管理网络:2个千兆端口,端口聚合 · 业务网络:2个千兆端口,端口聚合 · 存储外网、存储内网:复用2个万兆端口,端口聚合 |

|

方案3 |

2*2端口万兆以太网卡 |

· 管理网络、业务网络:复用2个千兆端口,端口聚合 · 存储外网、存储内网:复用2个万兆端口,端口聚合 |

· 分离部署场景,管理节点必须规划管理网和存储外网,业务网和存储内网不涉及。

· 以上部署拓扑为建议拓扑,请根据实际生产环境网络拓扑及服务器数量进行调整。

· 管理网络、存储外网、存储内网建议分离部署,承载在不同的物理网口上。

· 超融合集群6节点以上部署时,存储外网、存储内网务必使用分离部署,承载在不同的物理网口上。

· 当物理主机网络端口数量不充分时,Space Console管理平台支持同一个物理端口或聚合端口的网络复用。

· 存储内外网对应的物理网卡需要确保实际速率为万兆:即服务器网口,交换机端口,网线都确保万兆速率。

表3-18 网络规划示例

|

逻辑网络 |

IP地址 |

网关 |

VLAN |

|

iLO管理网络 |

172.88.211.0/24 |

172.88.211.254 |

9 |

|

管理网络 |

172.88.111.0/24 |

172.88.111.254 |

10 |

|

业务网络 |

192.168.1.0/24 |

192.168.1.254 |

11 |

|

存储外网 |

10.10.9.0/24 |

10.10.9.254 |

12 |

|

存储内网 |

10.10.10.0/24 |

10.10.10.254 |

13 |

表3-19 IP地址规划示例

|

主机节点 |

iLO网卡 (VLAN9) |

管理网卡(VLAN10) |

存储外网网卡(VLAN12) |

存储内网网卡(VLAN13) |

业务网卡(VLAN11) |

|

|

双机管理虚IP |

|

172.88.111.80(Workspace) 172.88.111.81(handy) |

|

|

|

|

|

iSCSI高可用IP |

|

|

10.10.9.1 |

|

|

|

|

管理节点#1 |

172.88.211.82 |

172.88.111.82 |

10.10.9.2 |

· 融合部署:10.10.10.2 · 分离部署:不涉及 |

· 融合部署:可以不配置 · 分离部署:不涉及 |

|

|

管理节点#2 |

172.88.211.83 |

172.88.111.83 |

10.10.9.3 |

· 融合部署:10.10.10.3 · 分离部署:不涉及 |

· 融合部署:可以不配置 · 分离部署:不涉及 |

|

|

业务节点#1 |

172.88.211.84 |

172.88.111.84 |

10.10.9.4 |

10.10.10.4 |

可以不配置 |

|

|

业务节点#2 |

172.88.211.85 |

172.88.111.85 |

10.10.9.5 |

10.10.10.5 |

可以不配置 |

|

|

业务节点#3 |

172.88.211.86 |

172.88.111.86 |

10.10.9.6 |

10.10.10.6 |

可以不配置 |

|

|

业务节点#4 |

172.88.211.87 |

172.88.111.87 |

10.10.9.7 |

10.10.10.7 |

可以不配置 |

|

· 由于Workspace产品docker服务器会默认占用172.17.0.0/16网段,所以网络规划需要避开该网段,以防引起冲突,部署失败。若无法避开该网段,请参考Docker服务器网段修改方法进行修改。

· 超融合场景双机管理虚IP包含Workspace虚IP和handy 虚IP,两者需要是相同网段的不同IP地址。搭建双机热备时,Workspace虚IP用于填写<虚IP地址>,handy虚IP用于填写<存储组件虚IP>。

· 无网口聚合时,基于网络分离原则,将存储业务/后端网络的网口根据网络不同,分别连接到不同交换机上。

· 推荐使用两台及两台以上的交换机通过IRF技术做堆叠,网口做动态链路聚合,链路聚合的对端连到不同的交换机上。

· 如果交换机启动了生成树协议(建议开启,交换机默认设置为启动生成树协议),则需要将所有连接服务器的交换机端口配置为边缘端口。详细方法参考第10.14 章。

· 交换机跨框转发时间时长参数IRF link-delay 要求设置为毫秒级。

图3-7 组织总体架构(办公场景)

图3-8 组织总体架构(教育场景)

表3-20 虚拟交换机规划

|

网卡 |

网络 |

绑定状态 |

虚拟交换机 |

|

NIC_0 |

管理 |

绑定 |

vswitch0 |

|

NIC_1 |

|||

|

NIC_2 |

业务 |

绑定 |

vs_business |

|

NIC_3 |

|||

|

HBA |

存储 |

多路径 |

vs_storage |

|

HBA |

同一个集群下,主机的虚拟交换机名称必须保持一致,同时也保证每台主机的虚拟交换机绑定的物理网卡的数量、绑定模式都保持一致,否则会导致虚拟机迁移异常、创建组织时无法选择虚拟交换机。

根据实际业务情况对虚拟机的CPU、内存、磁盘空间以及相关的硬件资源进行规划。这里以4核CPU,4G内存为例,通过最佳实践完成规划。并将规划虚拟机转换成虚拟机模板。

表3-21 办公桌面示例

|

硬件类型 |

参数 |

|

CPU |

4vCPU |

|

RAM |

4GB |

|

CPU工作模式 |

兼容模式 |

|

网卡设备型号 |

高速网卡 |

|

磁盘 |

系统盘40GB+数据盘自定义 |

根据实际业务情况对虚拟机的CPU、内存、磁盘空间以及相关的硬件资源进行规划。

表3-22 VDI课程示例

|

硬件类型 |

参数 |

|

CPU |

2vCPU |

|

RAM |

4GB |

|

CPU工作模式 |

兼容模式 |

|

网卡设备型号 |

高速网卡 |

|

磁盘 |

系统盘40GB |

表3-23 VOI课程示例

|

硬件类型 |

参数 |

|

CPU |

2vCPU |

|

RAM |

4GB |

|

CPU工作模式 |

兼容模式 |

|

网卡设备型号 |

高速网卡 |

|

磁盘 |

系统盘120GB |

· 虚拟机实际配置应根据业务需求灵活调整。

· Windows 10系统虚拟机至少需要配置2个vCPU。

表3-24 桌面池规划

|

名称 |

计算机类型 |

分配方式 |

用户类型 |

授权策略 |

虚拟交换机 |

网络策略 |

|

VDI桌面池1 |

VDI |

静态桌面池 |

域用户 |

Default |

vswitch0 |

Default |

|

VDI桌面池2 |

VDI |

动态桌面池 |

本地用户 |

新增策略 |

vswitch1 |

vlan2 |

|

VDI桌面池3 |

VDI |

手工桌面池 |

设备用户 |

新增策略 |

vswitch2 |

vlan3 |

|

IDV桌面池1 |

IDV |

单用户 |

本地用户 |

Default |

|

|

|

IDV桌面池2 |

IDV |

多用户 |

本地用户 |

Default |

|

|

|

VOI桌面池1 |

VOI |

单用户 |

本地用户 |

Default |

|

|

|

VOI桌面池2 |

VOI |

多用户 |

本地用户 |

Default |

|

|

桌面池规划,请以现场实际需求为准,可多种部署方式进行组合。

表3-25 教室规划

|

名称 |

计算机类型 |

座位数 |

网络配置 |

授权策略 |

网络策略 |

|

VDI教室1 |

VDI |

30 |

自动IP分配 |

Default |

Default |

|

VDI教室2 |

VDI |

50 |

静态IP分配 |

Default |

vlan2 |

|

VOI教室1 |

VOI |

40 |

|

Default |

|

|

VOI教室2 |

VOI |

50 |

|

Default |

|

· 教室规划,请以现场实际需求为准,可多种部署方式进行组合。

· 教室默认部署位置为集群,使用静态桌面池类型进行部署。

· 同一教室中的教师机和学生机需部署在同一网段,不同教室的教师机和学生机需部署在不同网段。

表3-26 用户与用户分组规划

|

用户类型 |

用户名 |

密码 |

用户/设备分组 |

OU |

备注 |

|

域用户 |

ADuser01~100 |

P@sswrd |

ADGroup |

ou=人力资源部,ou=xx股份公司, dc=xxx,dc=com,dc=cn |

需配置ldap |

|

本地用户 |

Localuser101~200 |

P@sswrd |

LocalGroup |

|

|

|

设备用户 |

终端MAC地址 |

|

DeviceGroup |

|

支持终端注册 |

表3-27 用户类别与用户分组规划(教育场景)

|

用户类别 |

用户名 |

密码 |

用户分组 |

班级 |

父分组 |

备注 |

|

|

|

|

School |

否 |

/ |

教学用户父分组 |

|

教职工用户 |

Teacher101~200 |

P@sswrd |

Teacher |

否 |

School |

|

|

学生用户 |

STUuser01~100 |

P@sswrd |

Class |

是 |

School |

需设置为班级 |

学生用户只能属于班级分组。

· 项目中若客户环境中不存在AD域控服务器,则需要新建配置域控服务器,并确保DNS服务器与AD域控服务器为同一服务器。

· 若客户环境中已存在AD域控服务器,则需要确认域控服务器域名及IP地址,DNS服务器是否与AD域控服务器为同一服务器,若不在,则需要确认DNS服务器的IP地址。

由于虚拟机或瘦终端等都需要解析Controller域名,请确保整个VDI环境都能访问DNS服务器并可以解析Controller域名。

在项目实施前需要对涉及域名解析的服务器规划好域名。

表3-28 域名规划

|

角色 |

域名 |

备注 |

|

AD |

ad.vdi.com |

|

|

DNS |

dns.vdi.com |

尽量与AD服务器部署在同一台服务器 |

|

Controller |

cloud.vdi.com |

|

· H3C Space Console管理平台安装请参考表2-20《H3C Workspace云桌面安装部署指导》Space Console管理平台安装章节。

· 若是低成本终端(如C5570V)作为教育场景UCC解决方案的管理平台节点,请参见C5570V终端作为低成本教育场景UCC解决方案的管理平台节点章节

H3C Space Console登录请参考表2-20《H3C Workspace云桌面 安装部署指导》的“系统登录”章节。

管理平台初始化分为融合部署和分离部署两种方式,可参考部署场景规划章节规划部署方式,按照规划结果进行管理平台部署。

· H3C Space Console管理平台初始化请参考表2-20《H3C Workspace云桌面安装部署指导》Space Console管理平台初始化章节。

· 融合部署双机热备,在初始化过程中添加作为管理节点的两台主机;分离部署双机热备,在初始化过程中仅添加一台作为管理节点的主机,另一台管理节点主机在初始化完成后,在管理平台->系统->双机热备配置中添加,注意服务器规划。

· 若主机侧配置“动态链路聚合”,则与对应物理接口连接的物理交换机端口必须配置动态聚合。当交换机侧完成了聚合模式的配置,出现无法发现主机的情况时,需要将主机管理网物理接口连接的交换机侧端口配置为聚合边缘接口,配置方法可参考交换机生成树边缘端口开启方法

如果交换机启动了生成树协议(默认),则需要将所有连接服务器的交换机端口配置为边缘端口。即在端口视图执行stp edged-port。

undo stp edged-port命令用来恢复缺省情况。

由于边缘端口不与其它设备相连,所以不会收到其它设备发过来的BPDU报文。在端口没有开启BPDU保护功能时,如果端口收到BPDU报文,即使用户设置该端口为边缘端口,该端口的实际运行状态也是非边缘端口。

二层以太网接口视图下的配置只对当前端口生效;二层聚合接口视图下的配置只对当前接口生效;聚合成员端口上的配置,只有当成员端口退出聚合组后才能生效。

# 配置端口GigabitEthernet1/0/1为边缘端口。

[Sysname] interface gigabitethernet 1/0/1

[Sysname-GigabitEthernet1/0/1] stp edged-port

· 交换机聚合边缘端口开启方法。然后再次扫描主机。

双机热备功能是对管理节点进行双机热备配置;当主管理节点发生故障时,通过主备管理节点的切换,管理节点可以对外正常提供服务。双机热备基于数据同步复制的方式实现。数据同步复制是指:主管理节点通过管理网实时将数据库文件等数据同步给备管理节点。

· 超融合架构部署必须配置双机热备,计算虚拟化部署是否配置双机根据实际业务需求确定。为了管理节点数据安全,在资源足够的条件下,开局时建议搭建双机环境。

· 仅支持新部署的Workspace管理平台搭建双机热备,不支持已有管理平台升级为双机热备,因为原有平台数据无法保留。

· 主备管理平台搭建双机热备后,不能再分离成单独的管理平台。

· 双机热备暂不支持半分离场景。即主节点在业务集群内,备节点不在或者主节点不在业务集群内,备节点在的场景。

预作为双机热备的主备节点主机,建议硬件配置保持一致。

预作为双机热备的主备节点主机,需要启动模式保持一致即:legacy模式或UEFI模式(建议使用UEFI模式)。

主备节点主机系统盘(sd*)磁盘数量、大小、RAID配置、扩展分区(名称、大小)要求完全一致。

主备节点的vms分区需要有足够的存储空间,至少大于20GB。

主备节点间的管理网络通信正常。

主备节点的系统时间保持一致。

在搭建双机热备前,主备节点上不能存在虚拟机,如果已经存在需先删除或迁移到其他主机。

在搭建双机热备前,主备节点上的存储池必须保持初始化结束后的默认配置。

双机热备环境,推荐使用iSCSI或FC共享目录类型的镜像存储同步桌面镜像数据,以避免同步桌面镜像数据时占用管理网络带宽。

图5-1 存储类型选择

· 双机热备主机因为网络异常出现脑裂,网络恢复正常后会自动协商出主管理平台。若脑裂时业务主机向备管理平台发送性能数据,脑裂恢复后,主机仍会向现在的备管理平台发送性能数据,导致主管理平台性能数据丢失。此时需在主管理平台上执行连接主机操作,保证业务主机性能数据发送正确。

· 在搭建双机热备的过程中,不能重启和关闭服务器。若出现服务器重启或断电,则需重新执行上述操作。

· 启用双机热备功能后,请不要再修改主机名称和IP地址,否则会出现严重问题。

· 双机搭建时,不可使用SSH终端工具访问/vms目录并进行操作。

· 若使用NVMe盘作为系统盘,则不支持搭建双机热备。

(1) 登录管理平台后单击[系统/双机热备管理/双机热备系统]菜单项,进入双机热备系统页面。

图5-2 双机热备系统

(2) 单击<热备搭建>按钮进行搭建。

· 计算虚拟化部署场景没有<存储组件虚IP>选项,其他配置和超融合架构部署配置一致。

· 以下以计算虚拟化部署场景为例进行双机配置。

图5-3 热备搭建

· 仲裁方式有两种选择:高级仲裁和简易Ping方式。

· 高级仲裁:需要配置仲裁节点IP以及主机root密码。

· 简易Ping方式:需要配置两个仲裁节点IP。

· 默认推荐高级仲裁方式搭建双机热备。

· 双机热备环境建议3台CVK主机集群以上搭建。

图5-4 具体配置示例

图5-5 操作提示

图5-6 确认

图5-7 热备搭建中

(3) 配置完成后会服务重启会自动退出当前登录,等待服务重启后,重新登录可查看配置。

图5-8 搭建完成

(4) 双机分离部署场景需要配置管理主机存储网络,确保管理双机的存储网和业务主机的存储外网互通。

图5-9 分离部署网络新建界面

图5-10 新建存储网络虚拟机交换机

图5-11 配置虚拟机交换机物理接口和IP

若双机热备环境需要使用桌面镜像、文件分发、命令下发、软件分发、一键求助、用户自助电子流、云盘、校园空间、终端监控信息等功能,则需要配置容量不少于500GB的双机共享存储。

(1) 登录管理平台后单击[系统/双机热备管理/共享存储]菜单项,进入双机共享存储页面。

(2) 单击<新建>按钮进行新建。

图5-12 共享存储新建

(3) 选择共享存储类型并配置相关参数。

图5-13 存储配置

(4) 单击<确定>按钮并启用存储,存储状态为活动。

图5-14 存储活动

(5) 登录管理平台后单击[系统/双机热备管理/配置检测]菜单项,进入双机配置检测页面。

(6) 选择检测项的迁移目的共享存储路径,单击<开始执行>按钮。

图5-15 开始检测

(7) 若检测结果符合要求检测状态为“已完成”;若状态为“待处理”,请按照提示进行处理后重新检测。

图5-16 检测完成

· 若小规模VOI管理服务器采用内存低于64G设备(例如C108V-H),管理节点内存预留配置方法可参考VOI低内存服务器管理节点预留内存配置方法。

· 若VOI服务器存储较小,不满足制作大存储终端设备镜像,可在管理节点进行对应终端的规格配置修改,配置方法可参考VOI小存储服务器管理大存储终端配置方法。

Workspace产品镜像存储支持本地文件目录、iSCSI共享目录、FC共享目录、NFS网络文件系统,如图6-1所示。以下根据业务部署场景来推荐镜像存储选择。

推荐用户使用iSCSI或FC等共享存储来做桌面镜像存储,以iSCSI共享目录添加方式为例,参考如下。

· 计算虚拟化部署场景镜像存储要使用共享存储时,需要客户现场已有iSCSI、FC等共享存储。

· Workspace产品推荐使用共享存储来存储桌面镜像。

新建本地存储需要先挂载本地磁盘,本地磁盘挂载方法可参考附录本地磁盘挂载指导章节。本地磁盘挂载完成后,新建本地存储的方法与共享存储类似。

图6-6 新建本地存储目录

图6-7 新建本地存储目录成功

超融合架构部署时,默认已部署分布式存储ONEStor,建议不使用默认配置的DefaultRbdNetStorage_hdd存储,推荐创建iSCSI共享存储,具体操作如下。

超融合分布式存储详细操作请参考表2-20《H3C Workspace云桌面 分布式存储配置指导》。

(1) 单击管理平台[ONEStor/块存储/卷映射/iSCSI高可用]菜单项,进入iSCSI高可用列表页面。

图6-8 iSCSI高可用列表页面

(2) 单击<新建>按钮,弹出高可用配置确认对话框,单击<确定>,进入高可用配置页面。

图6-9 高可用配置页面

(3) 输入iSCSI高可用IP,选择高可用组ID、主节点IP和备节点IP(建议添加所有节点为备节点IP),单击<确定>按钮。相关参数说明见下表。

表6-1 增加iSCSI高可用参数说明表

|

参数 |

说明 |

|

高可用IP |

用于访问集群块存储资源的虚拟IP地址。业务主机通过高可用IP访问集群块存储资源,即使因为节点故障而导致主备切换,业务主机也不感知。 |

|

高可用组ID |

iSCSI高可用组的编组ID。高可用组ID会下发至同组内所有节点,只有拥有相同高可用组ID的节点之间才能故障时进行主备切换。 |

|

负载均衡 |

开启负载均衡后,系统将根据各节点的负载情况智能地分配iSCSI连接,使各节点间的负载均衡。 |

|

多路径 |

当业务主机可通过多个物理路径访问块存储资源时,可以开启多路径功能,开启后,当路径中任何组件出现故障,业务主机可自动选择另一条可用路径访问块存储资源。 |

|

主用节点 |

提供iSCSI接入点的主用节点。 |

|

备用节点 |

当主用节点故障时提供iSCSI接入点的节点。 |

(4) 等待添加成功,即可在iSCSI高可用列表看到新添加的iSCSI高可用。

图6-10 添加iSCSI高可用成功

(1) 在管理平台单击[ONEStor/块存储/卷管理/存储卷]菜单项,并单击<新建>按钮。

图6-11 存储卷列表

图6-12 创建存储卷

(2) 配置存储卷名称以及大小,大小以实际镜像模板大小以及个数为准。

(3) 单击[ONEStor/块存储/卷映射/映射管理]菜单项,并单击业务主机组名称。

图6-13 映射管理

(4) 单击<添加>按钮,将上述创建的存储卷添加到业务主机组。

图6-14 主机存储卷

图6-15 添加卷至业务主机组-可选卷

图6-16 添加卷至业务主机组成功

超融合架构下,新建镜像存储的方法与计算虚拟化场景类似。

图6-17 新建镜像存储

图6-18 新建iSCSI共享目录

图6-19 选择LUN

图6-20 新建成功

办公场景管理平台详细配置请参考表2-20《H3C Workspace云桌面 业务快速部署(办公场景)》。

教学镜像存储配置可配置本地存储和GlusterFS存储,单机环境只能使用本地存储配置教学镜像存储,集群环境可在所有主机已配置本地教学镜像存储的基础上配置GlusterFS教学镜像存储。

· 小规模VOI管理服务器采用单磁盘设备(例如例如C108V-H、C5570V),且开局版本为E1011(包含E1011)之前的版本,若无法按下述流程配置,可参考VOI单磁盘服务器教学镜像存储配置方法。

· 小规模VOI管理服务器采用单磁盘设备(例如C108V-H)使用U盘安装Space Console完成后,需要拔掉U盘,否则在教学存储配置纳管磁盘时无法选到正确的磁盘。

· 教育场景VOI或UCC解决方案还需要在管理平台的[镜像/镜像存储]配置镜像存储后才可以正常发布课程,否则VOI课程发布的时候会因为没有配置镜像存储而无法发布。

新建教学镜像存储用于将主机中空闲的磁盘格式化后挂载到本地存储路径/vms/learningspace,或将集群中的共享存储挂载到本地存储路径/vms/learningspace下。挂载后,在课程存储池中将同时默认以此路径新建课程存储池,新建课程虚拟机或发布课程时可使用此路径的存储空间。同时后续新建的GlusterFS存储会挂载到/vms/learningspace/glusterfs路径下。

(1) 在H3C Space Console管理平台中单击导航栏中的[数据中心/教学存储配置]菜单项,进入教学镜像存储配置页面,单击页面中的<新建>按钮,弹出“新建”对话框。

图6-21 教学镜像存储配置

(2) 在“新建”对话框中,选择存储类型,支持本地磁盘或共享存储,本文以本地磁盘为例,单击<下一步>按钮。

图6-22 选择存储类型

· 新建共享存储前,请先在管理平台[数据中心/虚拟化/<集群名称>]菜单项中的“存储”页签中增加目标路径为/vms/learningstorage的共享存储和使用共享存储的主机。

· 多集群办公教育混合场景或多集群教育场景下,请勿新建存储类型为“共享存储”的教学镜像存储,否则会导致教室无法上课。

(3) 选择主机池、存储集群和主机,单击<下一步>按钮。

图6-23 选择主机池、存储集群与主机

(4) 选择空闲SSD磁盘,单击<确定>按钮,弹出操作确认对话框,输入“CONFIRM”,单击<确定>按钮确认操作,完成教学镜像存储的新建。

· 所选空闲磁盘需要为SSD磁盘,可在系统BIOS 界面中确认磁盘类型。

· 所选择的磁盘将会被格式化,格式化将导致磁盘上的原有数据丢失,请谨慎操作。

图6-24 选择空闲磁盘

图6-25 新建后的教学镜像存储

GlusterFS分布式文件系统具有强大的扩展能力、高可用性和高性能。在Learningspace的使用场景中,学校有着大量的班级与教室,因此需要多台主机组建集群使用,集群可以使用GlusterFS进行教学镜像、桌面虚拟机等文件的存储。

集群如果要使用GlusterFS存储,需要在集群配置GlusterFS的每个主机上添加名称相同的存储虚拟交换机。

当Learningspace集群的管理节点不作为业务节点使用时,如果要使用GlusterFS存储,管理节点上也要添加存储虚拟交换机,且每个节点上的存储虚拟交换机名称需要一致。方法为先将管理节点加入集群,然后添加存储虚拟交换机,完成后再从集群中删除该管理节点。

双机热备场景下,无论备节点是否加入GlusterFS集群,都需添加存储虚拟交换机,且名称需与其他节点相同,以确保主备切换时GlusterFS存储能正常使用。若备节点未添加同名存储虚拟交换机,但主备发生切换,请参见《H3C Workspace云桌面 维护手册》中GlusterFS章节对应步骤恢复GlusterFS配置。

(1) 在H3C Space Console管理平台中单击导航栏中的[数据中心/虚拟化]菜单项,进入虚拟化页面,单击页面左侧列表中的主机名称,单击右侧的“虚拟交换机”页签,单击页签下的<添加>按钮,弹出“增加虚拟交换机”对话框。

图6-26 虚拟化页面

(2) 在“增加虚拟交换机”对话框中,根据需求配置基本信息,网络类型选择“存储网络”。单击<下一步>按钮。

图6-27 增加虚拟交换机-基本信息

(3) 配置网络信息,若勾选多个物理接口,还需配置链路聚合与负载分担模式,配置完成后单击<确定>按钮,完成存储虚拟机的增加。

“增加虚拟交换机”中的网关一项无需配置。

图6-28 增加虚拟交换机-配置网络

图6-29 增加后的存储虚拟交换机

(4) 按照以上步骤依次在其余主机上增加同名存储虚拟交换机。

(1) 集群中所有主机配置本地教学镜像存储,配置方法参考配置教学镜像存储。

(2) 在H3C Space Console管理平台中单击导航栏中的[数据中心/教学存储配置/GlusterFS配置]菜单项,进入GlusterFS配置页面,单击页面中的<新建存储>按钮,弹出“新建存储”对话框。

图6-30 GlusterFS配置页面

(3) 在“新建存储”对话框中,选择存储类型,存储集群、主机、虚拟交换机和拓扑类型等,虚拟交换机选择之前新建的存储交换机,完成后单击<确定>按钮,弹出创建存储进度框,等待创建存储完成。

· 类型为“教学镜像存储”时,GlusterFS用于存储课程镜像与桌面虚拟机文件,挂载点与存储块路径为默认且不可修改。类型为“自定义存储”时,GlusterFS用于存储校园空间文件,可自定义挂载点与存储块路径。

· 挂载点:平台业务实际使用的文件夹路径。

· 存储块路径:GlusterFS物理存储块所在路径。

· 当新建存储为“自定义存储”或“双机热备存储”时:

· 存储块路径必须以主机上硬盘挂载点的路径开头,以确保其使用硬盘存储空间,且双机热备存储时,挂载点和存储块路径不能以/vms/开头。例如硬盘挂载点为/test/brick,推荐存储块路径设置为/test/brick/XX等;GFS挂载点设置为/test/brick/gluster。

· GFS挂载点路径和存储块路径不能存在一方为另一方的子路径的情况。例如GFS挂载点为/test/brick/gluster,则存储块路径不能为/test,/test/brick,/test/brick/gluster,/test/brick/gluster/XX等。

· 如果使用的是额外增加的硬盘,则硬盘需手动在后台挂载并格式化,然后把硬盘挂载信息写入/etc/fstab文件中,以免重启服务器后挂载信息丢失。

图6-31 新建存储

图6-32 创建存储进度框

(4) 创建存储完成之后,在GlusterFS配置页面上可以看到新建的GlusterFS存储信息。

教育场景管理平台详细配置请参考表2-20《H3C Workspace云桌面 快速入门(教育场景)》。

课程存储池即本地或共享存储路径的存储池(不包含GlusterFS存储路径),新建的课程虚拟机和发布的课程均可选择课程存储池中的存储路径。

· ARM架构主机暂不支持课程存储池配置。

· 课程存储池不包含GlusterFS存储路径,GlusterFS存储路径请在“GlusterFS配置”中管理。

· 教学存储初始化中新建的本地存储或共享存储,将默认以course_images_local名称显示在课程存储池配置中供使用。

· 批量选中的主机下需要同时存在同名的存储路径,在批量新建课程存储池时才可选择此存储路径。

(1) 单击左侧导航树[数据中心/教学存储配置/课程存储池配置]菜单项,进入课程存储池配置页面。

(2) 单击左侧的主机名,右侧列表将显示对应主机下的课程存储池,单击<新建>按钮,弹出“新建课程存储池”对话框。

图1-1 课程存储池配置页面

(3) 选择存储路径,包括本地存储和共享存储,此处以本地存储为例,单击<下一步>按钮。

图1-2 新建课程存储池

(4) 选择主机下的存储路径作为课程存储池,单击<确定>按钮,完成在所选主机下新建课程存储池。

图1-3 选择存储路径

图1-4 完成新建课程存储池

· 当课程存储池中存在课程虚拟机或课程时,禁止删除课程存储池。

· 删除课程存储池时,对应主机上的存储路径将不会被删除。

表7-1 计算虚拟化License

|

License类型 |

说明 |

|

云应用_H3C Workspace云桌面管理软件 |

Workspace云桌面管理License,包含VDI、VOI、IDV业务 |

|

云应用_H3C Learningspace管理软件 |

Learningspace管理License,包含VDI、VOI业务 |

表7-2 超融合License

|

License类型 |

说明 |

|

云应用_H3C Workspace云桌面管理软件 |

Workspace云桌面管理License,包含VDI、VOI、IDV业务 |

|

分布式存储_H3C ONEStor |

分布式存储服务License,支持ONEStor 2.0或3.0 License |

Workspace云桌面管理平台未被云操作系统纳管时,管理平台授权模式选择“License Server”,由与管理平台互通的License Server服务器进行授权管理,如下图管理平台License配置界面所示。

图7-1 管理平台本地授权

H3C Workspace云桌面管理平台本地授权步骤请参见表2-20《H3C软件产品远程授权License使用指南》。

· 推荐使用物理服务器搭建License Server,若无可用的物理服务器,可选择与物理服务器配置接近的虚拟机搭建,虚拟机搭建license server可参考License Server服务器搭建。

· 对于E1003-E1013(不含)版本Workspace,推荐使用E1145版本的License Server;对于E1013及以后版本Workspace,推荐使用E1205版本的License Server。请勿使用E1202版本的License Server。

H3C Workspace超融合架构完成部署后,如需使用ONEStor分布式存储,需在Workspace云桌面管理平台的[ONEStor/注册信息]中完成ONEStor的License注册与激活,如下图管理平台ONEStor注册信息页面所示。

图7-2 ONEStor注册信息页面

Workspace云桌面管理平台中的ONEStor分布式存储License授权方式为本地授权,具体参照步骤请参见表2-20《H3C ONEStor分布式存储产品License使用指南》。

H3C Workspace客户端的安装部署请参考表2-20《H3C Workspace云桌面安装部署指导》客户端安装与部署(办公场景)章节。

H3C Learningspace客户端的安装部署请参考表2-20《H3C Workspace云桌面安装部署指导》客户端安装与部署(教育场景)章节。

· VDI桌面使用、IDV桌面使用、VOI桌面使用等操作请参考表2-20《H3C Workspace云桌面 业务快速部署(办公场景)》。

· 详细功能验证请参考表2-20《H3C Workspace云桌面 对外测试手册》。

· 课程配置、新建教室、新建用户、上课、教学、下课等操作请参考表2-20《H3C Workspace云桌面 快速入门(教育场景)》。

· 详细功能验证请参考表2-20《H3C Workspace云桌面 对外测试手册》。

表10-1 Workspace产品默认密码

|

组件名称 |

默认密码 |

备注 |

|

Workspace管理平台Server后台 |

root:Sys@1234 |

|

|

Workspace管理平台Web前台 |

admin:Cloud@1234 |

默认超级管理员 |

|

Workspace管理平台Web前台 |

sysadmin:Sys@1234 |

默认系统管理员 |

|

Workspace管理平台Web前台 |

secauditor:Aud@1234 |

默认安全审计员 |

|

Workspace管理平台Web前台 |

secadmin:Sec@1234 |

默认安全保密管理员 |

|

SpaceOS 操作系统 root用户 |

root:Sys@1234 |

IDV终端E1007以前版本为root |

|

SpaceOS 操作系统 spaceos用户 |

spaceos:User@1234 |

|

|

Workspace客户端App返回终端密码卸载密码 |

Password@1234 |

在管理平台系统高级设置中可修改,E1007L01以前版本为Workspace@1234 |

|

Learningspace VDI学生端返回终端密码及卸载密码 |

Password@1234 |

在管理平台系统高级设置中可修改,E1007L01以前版本为Workspace@1234,若终端未连接过平台,E1010P04以前版本为h3c.com |

|

Learningspace VOI学生端返回终端密码及卸载密码 |

Password@1234 |

平台验证在管理平台系统高级设置中可修改,E1007L01以前版本为Workspace@1234,若终端未连接过平台,E1012以前版本为workspace.com |

|

VdiAgent卸载密码 |

无 |

管理平台可以设置是否开启及密码,E1012以前版本为Agent@1234 |

|

VOI/IDV终端镜像管理密码 |

admin:Cloud@1234 |

密码由管理平台下发,与管理平台保持一致 |

|

VOI/IDV终端配置静态IP地址密码 |

Password@1234 |

已连接过平台在管理平台系统高级设置中可修改,若终端未连接过平台,E1012以前版本为workspace.com |

|

VOI/IDV超级管理员密码 |

Password@1234 |

E1012以前版本为workspace.com |

|

VOI/IDV终端恢复出厂密码 |

Password@1234 |

已连接过平台在管理平台系统高级设置中可修改,E1007L01以前版本为Workspace@1234,若终端未连接过平台,E1012以前版本为workspace.com |

表10-2 Workspace客户端使用场景

|

场景 |

桌面架构 |

终端架构 |

安装包名称 |

安装对象 |

适配系统 |

适用终端 |

其他说明 |

|

教育场景 |

VDI |

X86 |

H3C_Learningspace_App-version-win32.zip |

教师终端、学生终端、课程虚拟机 |

Windows |

通用(windows系统设备均可) |

XP系统不支持 |

|

H3C_Learningspace_App- version-linux-x64.zip |

学生终端 |

SpaceOS |

C100E系列、C100X系列、C101LS系列、C202L系列 |

|

|||

|

H3C_Workspace_SpaceAgent-version-win32.zip |

教师终端、学生终端 |

Windows |

通用(windows系统设备均可) |

XP系统不支持 |

|||

|

H3C_Workspace_SpaceAgent-version-linux-x64.zip |

学生终端 |

SpaceOS |

C101LS系列 |

|

|||

|

H3C_SpaceOS-version-Upgrade-x86_64.zip |

学生终端 |

SpaceOS |

C100E系列、C100X系列、C101LS系列、C202L系列 |

|

|||

|

H3C_SpaceOS-HWE-version-Upgrade-x86_64.zip |

学生终端 |

SpaceOS |

C100L系列、C106V系列 |

|

|||

|

ARM32 |

H3C_Learningspace_App-version-linux-arm32.zip |

学生终端 |

SpaceOS |

C113系列 |

|

||

|

H3C_Workspace_SpaceAgent-version-linux-arm32.zip |

学生终端 |

SpaceOS |

C113系列 |

|

|||

|

H3C_SpaceOS-version-Upgrade-arm32.zip |

学生终端 |

SpaceOS |

C113系列 |

|

|||

|

VOI |

X86 |

H3C_Spacelauncher_VOI_UEFI-version-x86_64.zip |

VOI学生终端 |

SpaceOS |

C100V系列、C106V系列、C107V系列、C108V系列、C200V、 C201V、C202V系列、 C206V系列、C207V系列、C208V系列 |

|

|

|

H3C_Spacelauncher_VOI_UEFI-version-x86_64-K511.zip |

VOI学生终端 |

SpaceOS |

C5010V系列、C5013V系列、C5320V系列、C5323V系列、C5520V系列、C5523V系列、 C5550V系列、C5560V系列、C5570V系列、 C6030V系列、C6330V系列、C6530V系列 |

|

|||

|

H3C_SpaceOS_UCC-version-Upgrade-x86_64.zip |

UCC学生终端 |

SpaceOS |

· 非Intel酷睿系列终端: · C100V系列、C106V系列、C202V系列、C206V系列、C3300V、 · C5000V G2、C5010V、 · C5013V G2、C5030V G2、C5050V G2、C6030V、 · C6030V G2 · 第九代Intel酷睿终端: · C107V系列、C108V系列、C207V系列、C208V系列 · 第十代Intel酷睿终端: · C5320V、C5323V、C5520V、C5523V、C5550V、C5560V、C5570V、C6330V、C6530V 第十二代Intel酷睿终端:C5300V G2、C5330V G2、C5350V G2、C5500V G2、C5530V G2、C5550V G2、C6330V G2、C6530V G2 |

|

|||

|

H3C_SpaceOS_UCC-version-x86_64.iso |

UCC学生终端 |

SpaceOS |

· 非Intel酷睿系列终端: · C100V系列、C106V系列、C202V系列、C206V系列、C3300V、 · C5000V G2、C5010V、 · C5013V G2、C5030V G2、C5050V G2、C6030V、 · C6030V G2 · 第九代Intel酷睿终端: · C107V系列、C108V系列、C207V系列、C208V系列 · 第十代Intel酷睿终端: · C5320V、C5323V、C5520V、C5523V、C5550V、C5560V、C5570V、C6330V、C6530V 第十二代Intel酷睿终端:C5300V G2、C5330V G2、C5350V G2、C5500V G2、C5530V G2、C5550V G2、C6330V G2、C6530V G2 |

|

|||

|

办公场景 |

VDI |

X86 |

H3C_Workspace_Configure-version-win32.exe |

客户端定制工具 |

Windows |

通用(windows系统设备均可) |

XP系统不支持 |

|

H3C_Workspace_Configure-version-linux-x64.deb |

客户端定制工具 |

SpaceOS |

C101LS系列 |

|

|||

|

H3C_Workspace_App-version-win32.zip |

windows终端 |

Windows |

通用(windows系统设备均可) |

XP系统不支持 |

|||

|

H3C_Workspace_SpaceAgent-version-win32.zip |

windows终端 |

Windows |

通用(windows系统设备均可) |

XP系统不支持 |

|||

|

H3C_Workspace_App-version-linux-x64.zip |

linux终端 |

SpaceOS、UOS |

C101LS系列、C202L系列、C500 |

|

|||

|

H3C_Workspace_SpaceAgent-version-linux-x64.zip |

linux终端 |

SpaceOS、UOS |

C101LS系列、C202L系列、C500 |

|

|||

|

H3C_SpaceOS-version-Upgrade-x86_64.zip |

SpaceOS终端 |

SpaceOS |

C101LS系列、C202L系列 |

|

|||

|

H3C_SpaceOS-HWE-version-Upgrade-x86_64.zip |

SpaceOS终端 |

SpaceOS |

C100L系列、C106V系列 |

|

|||

|

ARM32 |

H3C_Workspace_Configure-version-linux-arm32.deb |

客户端定制工具 |

SpaceOS |

C113系列 |

|

||

|

H3C_Workspace_App-version-linux-arm32.zip |

ARM32终端 |

SpaceOS |

C113系列 |

|

|||

|

H3C_Workspace_SpaceAgent-version-linux-arm32.zip |

ARM32终端 |

SpaceOS |

C113系列 |

|

|||

|

H3C_SpaceOS-version-Upgrade-arm32.zip |

SpaceOS终端 |

SpaceOS |

C113系列 |

|

|||

|

ARM64 |

H3C_Workspace_Configure-version-linux-aarch64.deb |

客户端定制工具 |

UOS、 Kylin |

CD2000、银河麒麟系统终端 |

|

||

|

H3C_Workspace_App-version-linux-aarch64.zip |

ARM64终端 |

UOS、 Kylin |

CD2000、银河麒麟系统终端 |

|

|||

|

H3C_Workspace_SpaceAgent-version-linux-aarch64.zip |

ARM64终端 |

UOS、Kylin |

CD2000、银河麒麟系统终端 |

|

|||

|

MIPS64 |

H3C_Workspace_App-version-UOS-mips64el.zip |

MIPS64终端 |

UOS |

清华同方龙芯3A-4000 |

|

||

|

H3C_Workspace_SpaceAgent-version-UOS-mips64el.zip |

MIPS 64终端 |

UOS |

清华同方龙芯3A-4000 |

|

|||

|

H3C_Workspace_App-version-linux-mips64el.zip |

MIPS 64终端 |

Kylin |

|

|

|||

|

H3C_Workspace_SpaceAgent-version-linux-mips64el.zip |

MIPS 64终端 |

Kylin |

|

|

|||

|

MacOS |

H3C_Workspace_App-version-macOS.zip |

苹果电脑 |

MacOS |

|

|

||

|

iOS |

H3C_Workspace_App-version -iOS.zip |

苹果手机 |

iOS |

|

只能从应用商店下载 |

||

|

android |

H3C_Workspace_App-version -android.zip |

安卓手机 |

Android |

|

|

||

|

H3C_Workspace_App-version –android-SS.zip |

安卓智慧屏 |

Android |

|

|

|||

|

IDV |

X86 |

H3C_IDVAgent-version-linux-x64.zip |

IDV终端 |

SpaceOS |

C102V、C103V、C105V、C107i系列 |

|

|

|

H3C_Spacelauncher_IDV-version-linux-x86_64.zip |

IDV终端 |

SpaceOS |

C102V、C103V、C105V |

|

|||

|

H3C_Spacelauncher_IDV-version-linux-x86_64-K510.zip |

IDV终端 |

SpaceOS |

C107i系列 |

|

|||

|

VOI |

X86 |

H3C_Spacelauncher_VOI_UEFI-version-x86_64.zip |

VOI终端 |

SpaceOS |

C100V系列、C106V系列、 C107V系列、C108V系列、C202V系列、C206V系列、C207V系列、C208V系列 |

|

|

|

H3C_Spacelauncher_VOI_UEFI-version-x86_64-K511.zip |

VOI终端 |

SpaceOS |

C5010V系列、C5013V系列、C5320V系列、C5323V系列、C5520V系列、C5523V系列、 C5550V系列、C5570V系列、 C6030V系列、C6330V系列、C6350V系列 |

|

|||

|

|

VOI |

X86 |

H3C_SpaceOS_UCC-version-Upgrade-x86_64.zip |

UCC终端 |

SpaceOS |

· 非Intel酷睿系列终端: · C100V系列、C106V系列、C202V系列、C206V系列、C3300V、 · C5000V G2、C5010V、 · C5013V G2、C5030V G2、C5050V G2、C6030V、 · C6030V G2 · 第九代Intel酷睿终端: · C107V系列、C108V系列、C207V系列、C208V系列 · 第十代Intel酷睿终端: · C5320V、C5323V、C5520V、C5523V、C5550V、C5560V、C5570V、C6330V、C6530V 第十二代Intel酷睿终端:C5300V G2、C5330V G2、C5350V G2、C5500V G2、C5530V G2、C5550V G2、C6330V G2、C6530V G2 |

|

|

|

VOI |

X86 |

H3C_SpaceOS_UCC-version-x86_64.iso |

UCC终端 |

SpaceOS |

· 非Intel酷睿系列终端: · C100V系列、C106V系列、C202V系列、C206V系列、C3300V、 · C5000V G2、C5010V、 · C5013V G2、C5030V G2、C5050V G2、C6030V、 · C6030V G2 · 第九代Intel酷睿终端: · C107V系列、C108V系列、C207V系列、C208V系列 · 第十代Intel酷睿终端: · C5320V、C5323V、C5520V、C5523V、C5550V、C5560V、C5570V、C6330V、C6530V 第十二代Intel酷睿终端:C5300V G2、C5330V G2、C5350V G2、C5500V G2、C5530V G2、C5550V G2、C6330V G2、C6530V G2 |

|

授权服务器上需安装H3C License Server授权管理软件,用于为H3C Workspace提供授权服务,具有集中管理授权、集中分发授权、HA(High Availability,高可靠性)等功能,可以简化用户的License使用、解决动态业务授权控制等问题。License server版本安装包可在H3C官网获取:https://www.h3c.com/cn/Service/Document_Software/Software_Download/License_Server/Catalog/License_Server/License_Server/?CHID=510727 ;若无法获取,请联系H3C技术服务工程师。

· 对于E1003-E1013(不含)版本的Workspace,推荐使用E1145版本的Licence Server;对于E1013及以后版本的Workspace,推荐使用E1205版本的License Server。请勿使用E1202版本的License Server。

· E1013及以后版本的Workspace建议安装E1205及以后版本的License Server,以便在Workspace管理平台查看License维保状态。

· 配置License Server时,存储不要选择classroom开头及course_image开头的存储池。

(1) 上传License server镜像文件。

图10-1 上传镜像文件

(2) 镜像选择“LICENSE-SERVER-ISO-E1145”。

图10-2 镜像选择

图10-3 上传成功

(3) 创建虚拟机挂载ISO部署安装License Server。

图10-4 创建虚拟机

(4) 虚拟机基本配置信息。

图10-5 虚拟机基本配置

· 操作系统选择Linux,版本选择CentOS 6/7 64位。

· 虚拟机部署License Server时,自动迁移不开启。

图10-6 基础硬件信息配置

· 硬件配置CPU建议2vCPU以上,内存2GB以上,磁盘容量80GB。

· 教育场景LicenseServer虚拟机磁盘不能使用教室存储路径,强烈建议使用本地存储。

(5) 光驱选择开始上传的LicenseServer ISO镜像。

图10-7 选择LicenseServer ISO

(6) 启动虚拟机,开始安装。

图10-8 启动虚拟机

(7) 打开控制台开始安装。

图10-9 打开控制台

(8) 系统语言选择,默认使用英语。

图10-10 语言选择

(9) 选择键盘。

图10-11 选择键盘

(10) 选择默认键盘布局。

图10-12 选择默认键盘布局

(11) 开始安装。

图10-13 开始安装

(12) 开始安装,安装过程中设置root密码。

图10-14 设置root密码

(13) root密码设置。

图10-15 密码设置

(14) 等待安装完成。

图10-16 等待安装

(15) 安装完成后,输入用户名root密码后登录。

图10-17 root登录

(16) 配置网卡eth0配置。

推荐LicenseServer配置静态IP。

图10-18 配置网卡eth0

图10-19 重启网络服务:

License Server 搭建完成后,需要在License Server或外部网络设备中,关闭防火墙或放通相应端口。

登录License Server管理平台<https://ip:28443/licsmgr>,输入用户名/密码默认缺省为admin/admin@h3c。

图10-20 登录页面

两台主备License Server搭建在不同业务主机上,单主机环境或集群主机资源不充足的情况下不需要搭建License Server HA。搭建方法见上节。

图10-21 配置HA

图10-22 配置完成

启动风暴(Boot Storm)通常发生在大量虚拟桌面在短时间内同时启动的情况下,例如上午8点到9点的上班时间。由于虚拟桌面初始启动时需从磁盘读取大量数据以加载和执行,因此大量虚拟桌面同时启动,将会使服务器CPU、硬盘等负载突然增加,从而导致虚拟桌面开机时间长、桌面操作卡顿等情况。HDD硬盘受限于磁盘转速等本身机械性限制,是造成启动风暴不可忽视的因素。但部分用户可能成本受限,无法按照存储规划中所述配置SSD盘。

鉴于这种情况,Workspace提供了桌面池和虚拟机的定时任务配置功能。通过在管理平台配置桌面池或虚拟机的定时启动任务,使用户虚拟桌面错峰开机,从而避免启动风暴的产生,提高用户体验。具体配置步骤如下:

(1) 在管理平台中,单击[系统/高级设置/定时任务]菜单项,进入定时任务列表页面。

图10-23 桌面池任务列表

(2) 单击<新建>按钮,在弹出的对话框中配置执行对象为“桌面池”,任务类型为“开机”,并设置执行周期、执行日期、执行时间后,单击<下一步>按钮,在选择执行对象步骤中添加要启动的桌面池,单击<下一步>按钮,确认信息后单击<确定>按钮,完成操作。

图10-24 新建桌面池任务

(3) 与桌面池定时任务类似,针对于单一虚拟桌面,也可以配置其定时任务。在管理平台中,单击[系统/高级设置/定时任务]菜单项,进入定时任务列表页面。

(4) 单击<新建>按钮,在弹出的对话框中配置执行对象为“虚拟机”,任务类型为“开机”,并设置执行周期、执行日期、执行时间后,单击<下一步>按钮,在选择执行对象步骤中添加要启动的虚拟机,单击<下一步>按钮,确认信息后单击<确定>按钮,完成操作。

图10-25 新建虚拟机任务

(1) 执行命令fdisk -l查询本地磁盘。

图10-26 查询本地磁盘

(2) 创建本地挂载路径。

SSD磁盘用于存储虚拟机系统盘镜像文件,挂载点取名vmsys(可根据习惯取名);同理HDD磁盘用于存储虚拟机数据盘镜像文件,挂载点取名vmstor(可根据习惯取名)。

图10-27 创建本地挂载路径

(3) 初始化SSD磁盘。

图10-28 初始化SSD磁盘

(4) 初始化HDD磁盘。

图10-29 初始化HDD磁盘

(5) Mount挂载本地磁盘。

图10-30 挂载本地磁盘

(6) 执行命令df –h查询挂载结果。

图10-31 查询磁盘

(7) 执行命令blkid查询挂载磁盘UUID,启动项写入配置文件fstab。

图10-32 查询磁盘UUID

(8) 编辑/etc/fstab文件,追加下图所示配置并保存。

图10-33 配置启动项

(1) 增加SSD磁盘,即挂载vmsys。

图10-34 增加SSD磁盘

(2) 增加HDD磁盘即添加vmstor。

图10-35 增加HDD磁盘

· 扩容主机预先安装版本须和已有Workspace集群版本一致。

· 扩容主机管理IP地址大于当前环境的最小IP地址。

(1) 将新增主机安装与已有集群环境版本一致的Workspace系统。

图10-36 主机发现

(2) 登录已有集群管理平台,进入数据中心菜单项,点击<集群>页面后,点击<主机发现>进入主机添加页面。

图10-37 主机添加页面

(3) 主机发现列表中找到对应目标主机,先点击<配置网卡>进行主机网卡配置。

图10-38 配置网卡

(4) 网卡配置修改成功后并确认;然后再点击<添加到集群>。

图10-39 主机添加到集群

(5) 等待添加进程结束后进入集群查看添加结果,若有共享存储配置等配置请在新增主机存储页面进行配置。

图10-40 查看添加结果

图10-41 添加成功

(1) 在数据中心>主机池>集群页面,点击<主机发现>按钮进入主机发现页面。

图10-42 主机发现

(2) 选择目标主机,配置网卡信息。

图10-43 网卡配置

主机存储内外网需要确保实际速率是万兆:网口和网线。

(3) 确认网卡配置后,点击<选择主机添加到集群>将目标主机添加到集群。

图10-44 添加主机到集群

(4) 确认主机信息。

图10-45 主机配置信息确认

(5) 主机添加完成,弹出存储配置。

图10-46 磁盘信息加载

(6) 等待磁盘信息加载后,将数据盘和缓存盘移到硬盘池区域。

图10-47 磁盘选择

(7) 配置完数据盘和缓存盘信息后,点击<下一步>。

图10-48 主机用途

(8) 修改主机用途,并确认;即可在任务台中查看存储配置进度。

License扩容操作与License授权操作相同,请参考License授权管理中授权部分。

[root@cvknode5 ~]# lspci|grep Adaptec

5c:00.0 Serial Attached SCSI controller: Adaptec Smart Storage PQI 12G SAS/PCIe 3 (rev 01)

然后通过arcconf list命令查看能否获取到RAID卡信息,如果不能则需要进一步查询。如下图所示,如果用ssacli ctrl all show 可以查询到信息,则说明此RAID卡实际上要用ssacli命令来处理。具体方式查看hpe卡说明。

[root@cvknode6 ~]# lspci |grep -i "lsi"

18:00.0 RAID bus controller: LSI Logic / Symbios Logic MegaRAID SAS-3 3108 [Invader] (rev 02)

Lspci | grep "Hewlett-Packard Company Smart Array" 返回结果不为空,或者如下图所示。

针对P408i或者P816i 型号RAID卡,也判断为hpe型号RAID卡。

(1) 查看RAID卡状态,当RAID卡状态不正常时,设置缓存可能失败。

(2) 查看磁盘信息,确认逻辑磁盘状态是否处于ok状态。

(3) 查看逻辑盘对应的缓存信息。

(4) 如上图所示,可以查询到逻辑磁盘序号与盘符的对应关系 以及逻辑缓存的状态。

(5) 磁盘物理缓存配置:物理缓存统一进行设置,要求处于关闭状态。

a. 查看缓存状态

b. 关闭物理缓存

ssacli ctrl slot=2 modify drivewritecache=disable forced

c. 开启物理缓存

ssacli ctrl slot=2 modify drivewritecache=enable forced

(6) 逻辑磁盘缓存配置:查看缓存状态,可以根据2.1.4 的信息进一步确认需要关闭的缓存。

a. 打开逻辑缓存:如上所示,假如需要打开缓存的对应逻辑盘1,执行如下命令

ssacli ctrl slot=2 logicaldrive 1 modify caching=enable

b. 关闭逻辑缓存

ssacli ctrl slot=2 logicaldrive 1 modify caching=disable

adaptec型号的RAID卡,目前已经支持的具体型号分为两类,一类是PMC8060,另外一类是P460系列,已知的有P460-B4/ P460-M4/P4408/P2404。

(1) 识别的方法后台执行脚本,执行arcconf list 查看关键字段信息。

图10-49 P460-B4信息

图10-50 PMC8060信息

(2) 查看RAID卡状态。

(3) 查看磁盘信息:查看逻辑磁盘信息,使用arcconf getconfig 1 ld //1为controller号。

a. P460系列

b. PMC8060:PMC无法直接查找到盘符,需要根据unique identifier查询。

c. 查询盘符

(4) 逻辑磁盘缓存配置。

· P460系列

a. 查看逻辑缓存状态

arcconf getconfig 1 ld |grep “Caching”

b. 打开逻辑缓存

arcconf setcache 1 logicaldrive 0 con

c. 关闭逻辑缓存

arcconf setcache 1 logicaldrive 0 coff

· PMC8060

a. 查看逻辑缓存状态

arcconf getconfig 1 ld |grep “Write-cache status”

b. 打开逻辑缓存

arcconf setcache 1 logicaldrive 0 wbb

c. 关闭逻辑缓存

arcconf setcache 1 logicaldrive 0 wt

(5) 物理磁盘缓存配置。

· P460系列

a. 查看物理缓存状态:针对P460系列的磁盘,则采用如下字段。Default和disable都是表示关闭缓存。

b. 关闭物理缓存

arcconf setcache 1 drivewritecachepolicy configured 2

//0:默认值 1:打开 2:关闭 configured:已经配置的磁盘 unconfigured:未配置的磁盘

c. 打开物理缓存

arcconf setcache 1 drivewritecachepolicy configured 1

· PMC8060

a. 查看物理缓存状态

arcconf getconfig 1 pd | grep "Write Cache"

b. 关闭物理缓存

arcconf setcache 1 deviceall disable noprompt

c. 打开物理缓存

arcconf setcache 1 deviceall enable noprompt

(1) 查看RAID卡状态:获取control号,如下为control号为0。

(2) 获取RAID卡状态信息,optimal 表示状态正常。

(3) 查看磁盘信息。

a. 查看逻辑磁盘的信息

[root@cvknode6 ~]# /opt/MegaRAID/storcli/storcli64 /c0 /vall show all

b. 更加scsi NAA id 查看逻辑磁盘对应的盘符。

/lib/udev/scsi_id –g –u /dev/sdd 遍历所有盘符,得到 与scsi NAA id相等的盘符即是该逻辑盘对应的盘符。

(4) 逻辑磁盘缓存配置。

a. 查看逻辑磁盘信息

b. 打开逻辑磁盘缓存,/c0 中的0表示control号(2.3.1节获取的方法获取),/v0的0 表示逻辑磁盘序号。Writeback表示打开缓存,writethrough表示关闭缓存。

/opt/MegaRAID/storcli/storcli64 /c0 /v0 set wrcache=wb

c. 关闭逻辑磁盘缓存

/opt/MegaRAID/storcli/storcli64 /c0 /v0 set wrcache=wt

(5) 物理磁盘缓存配置。

a. 查看物理磁盘缓存信息

/opt/MegaRAID/storcli/storcli64 /c0/eall/sall show all | grep "Write Cache"

b. 关闭物理缓存

/opt/MegaRAID/storcli/storcli64 /c0/vall set pdcache=off

c. 打开物理缓存

/opt/MegaRAID/storcli/storcli64 /c0/vall set pdcache=on

表10-3 非硬盘故障导致宕机(例如CPU/内存/电源/系统盘/RAID卡等)

|

副本数 |

最小副本数 |

故障类型 |

一个节点故障 |

两个节点故障 |

三个节点故障 |

最小节点配置 |

推荐节点配置 |

|

3 |

2(默认) |

同时故障(在数据再平衡完成之前再次发生平衡) |

业务和数据都不影响 |

业务受影响,数据安全 |

业务受影响,数据安全 |

3节点 |

5节点及以上 |

|

3 |

1 |

业务和数据都不影响 |

4节点及以下:业务可能受影响,数据安全 5节点及以上:业务不受影响,数据安全 |

业务受影响,数据安全 |

3节点 |

5节点及以上 |

|

|

2 |

1 |

业务和数据都不影响 |

业务受影响,数据安全 |

业务受影响,数据安全 |

2节点 |

5节点及以上 |

|

|

3 |

2 |

非同时故障(在数据再平衡完成之后再次发生平衡) |

业务和数据都不影响 |

4节点及以下:业务可能受影响,数据安全 5节点及以上:业务不受影响,数据安全 |

6节点及以下:业务可能受影响,数据安全 7节点及以上:业务不受影响,数据安全 |

3节点 |

5节点及以上 |

|

3 |

1 |

业务和数据都不影响 |

4节点及以下:业务可能受影响,数据安全 5节点及以上:业务不受影响,数据安全 |

6节点及以下:业务可能受影响,数据安全 7节点及以上:业务不受影响,数据安全 |

3节点 |

5节点及以上 |

|

|

2 |

1 |

业务和数据都不影响 |

4节点及以下:业务可能受影响,数据安全 5节点及以上:业务不受影响,数据安全 |

6节点及以下:业务可能受影响,数据安全 7节点及以上:业务不受影响,数据安全 |

2节点 |

5节点及以上 |

表10-4 硬盘故障(硬盘数据无法恢复)

|

副本数 |

最小副本数 |

故障类型 |

一个节点硬盘故障(包含单节点多个故障硬盘) |

两个节点硬盘故障(包含跨节点多个故障硬盘) |

三个节点硬盘故障(包含跨节点多个故障硬盘) |

最小节点配置 |

推荐节点配置 |

|

3 |

2(默认) |

同时故障(在数据再平衡完成之前再次发生平衡) |

业务和数据都不影响 |

业务受影响,数据安全 |

业务受影响,数据丢失 |

3节点 |

5节点及以上 |

|

3 |

1 |

业务和数据都不影响 |

业务不受影响,数据安全 |

业务受影响,数据丢失 |

3节点 |

5节点及以上 |

|

|

2 |

1 |

业务和数据都不影响 |

业务受影响,数据丢失 |

业务受影响,数据丢失 |

2节点 |

5节点及以上 |

|

|

3 |

2 |

非同时故障(在数据再平衡完成之后再次发生平衡) |

业务和数据都不影响 |

业务和数据都不影响 |

业务和数据都不影响 |

3节点 |

5节点及以上 |

|

3 |

1 |

业务和数据都不影响 |

业务和数据都不影响 |

业务和数据都不影响 |

3节点 |

5节点及以上 |

|

|

2 |

1 |

业务和数据都不影响 |

业务和数据都不影响 |

业务和数据都不影响 |

2节点 |

5节点及以上 |

· 副本数指的是数据池的冗余策略。如3副本,则表示集群中该数据池的数据存放了3份。

· 最小副本数指的是最小工作副本数,只有集群所有数据的副本数不小于最小副本数时,集群才能正常提供服务。

· 以上是默认故障域是主机的情况,如果故障域设置为机架,在同一个故障域内部的多节点故障,等同于单副本故障(但是要求大于一半节点正常)。

· 数据再平衡是指硬件故障后,多副本在剩余节点上重新部署的过程.数据再平衡的时间长短依赖于存储数据量的大小,一般情况下最慢0.5小时/1T。

· 节点故障后业务是否能够正常恢复,除了考虑可靠性以外,还与容量有关。即节点故障后,剩余节点的CPU、内存、硬盘是否能够满足现有业务的需求,一般情况下建议资源使用量要留有余量,应保证至少2个节点故障后,剩余节点承载现有业务没有问题。

· 缓存盘的故障,如果只做了raid0, 缓存盘故障等于这个缓存盘所对应的数据盘故障。

· 硬盘故障若最终无法恢复,可联系专业数据恢复公司,尝试恢复硬盘数据。

手动安装与卸载客户端请参考表2-20《H3C Workspace云桌面安装部署指导》附录相关章节。

· 规划修改的docker网段需要是环境中未被使用的网段。

· 管理平台未初始化,docker网段修改需要在每台服务器进行修改操作。

· 管理平台已初始化完成,docker网段修改在管理节点进行修改操作即可。

· 管理平台已初始化完成且docker网段已修改,新增节点若作为业务节点,则无需修改docker网段,直接添加即可;新增节点若作为搭建双机热备的节点,则需要执行docker网段修改后再添加,且修改内容与主节点保持一致。

· 双机热备环境搭建已完成,docker网段修改在主节点进行修改操作,备节点仅增加与主节点一致的SNAT规则即可,即执行步骤(4)。

· 业务节点不运行docker,无用的docker0网口可以删除,若需删除业务节点的docker网络,可将业务节点服务器重启,或在业务节点执行以下两条命令:(1)ifconfig docker0 down;(2)brctl delbr docker0。

(1) 后台进入/etc/docker目录,查看是否存在daemon.json,若不存在则新建一个。

(2) vim daemon.json编辑文件内容,修改网段为规划网段并保存(此处以192.168.0.1/24网段为例),cat daemon.json确认修改正确。

(3) service docker restart重启docker服务。

(4) 执行命令iptables-save -c,在显示的信息中可以发现除了默认的172.17.0.0/16 SNAT规则,会多出一条192.168.0.0/24的新增规则:[0:0] -A POSTROUTING -s 192.168.0.0/24 ! -o docker0 -j MASQUERADE。如果在该处查询时没有发现有多出的规则,则执行命令iptables -t nat -A POSTROUTING -s 192.168.0.0/24 ! -o docker0 -j MASQUERADE手动进行增加,然后再次查询(如果是双机热备环境,备机也需要手动增加此规则)。

(5) vim /etc/cvm/iptables.roles,将文件中默认的172.17.0.0/16规则修改为步骤(4)查询看到的新增的规则。

(6) 将获取的reloadDocker-xxx-X86.tar或reloadDocker-xxx-ARM.tar文件上传到CVM主机,执行tar –zxf reloadDocker-xxx.tar.gz将上传文件解压。

请联系H3C技术服务工程师获取需要的运行脚本包reloadDocker-xxx-X86.tar或reloadDocker-xxx-ARM.tar。

(7) 进入解压的文件路径,执行命令chmod 777 reLoadMain.sh.x修改reLoadMain.sh.x文件权限。

(8) 执行脚本./ reLoadMain.sh.x。

(9) ifconfig docker查询docker ip,确认使用网段。

(10) 登录管理平台查看license状态正常,云盘(若启用)正常工作,修改完成。

(1) 在H3C Space Console管理平台中单击导航栏中的[系统/高级设置]菜单项,进入高级参数设置页面。

图10-51 高级参数设置页面

(2) 单击高级参数配置页面管理平台主机参数编辑图标,在编辑界面启用管理节点内存预留参数,设置管理节点内存预留值为4096MB(可做适当调整),单击保存按钮。

图10-52 修改管理平台预留内存

(3) 弹出的修改提示页面,勾选“已充分了解本操作造成的结果”并输入管理平台登录密码,单击确定按钮。

图10-53 修改管理平台预留内存提示框

(1) 在H3C Space Console管理平台中单击导航栏中的[系统/规格配置]菜单项,选中对应大存储终端进行编辑。

图10-54 选择大存储终端

(2) 根据需要调整大存储终端系统盘小于服务器可用空间。

图10-55 修改磁盘容量

· 系统盘大小建议不超过200GB。

· 512GB硬盘规格终端建议系统盘和数据盘总容量不超过302GB。

(1) 制作U盘启动盘,操作步骤与服务器一致,请参见《H3C Workspace云桌面 安装部署指导》4.2制作U盘启动盘一节。

(2) 将U盘插入终端背板3.0 USB口,按下终端电源按钮,并按F12,选择U盘启动。

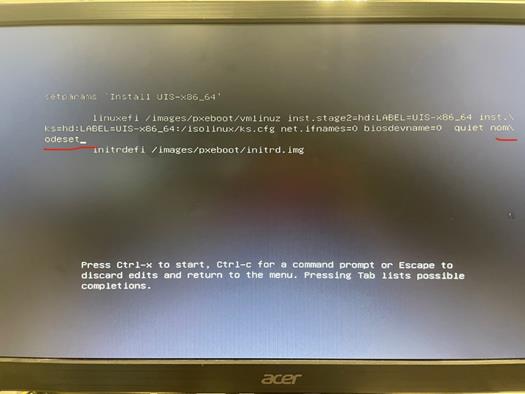

(3) 进入U盘启动页面,在非auto方式下,手动安装系统选项按“E键”修改启动参数nomodeset配置项,如下图所示,按下“Ctrl+x”,引导至正常安装过程。

图10-56 修改启动参数

· 制作启动盘安装管理平台时,在C5570V终端刷入管理平台版本时,非auto手动安装系统时有时出现分辨率问题,建议重启进行恢复。

· 管理平台初始化完成后,在管理平台的[系统/高级设置/高级参数]页面修改管理平台主机参数(1024MB),若不改此项,虚拟机将无法开机。修改方法请参见VOI低内存服务器管理节点预留内存配置方法。

C5570V终端作为UCC终端的教育管理节点的使用限制主要在于内存空间。如下图所示,C5570V终端总内存为30GB左右,新装管理平台占用17GB,管理节点内存预留1GB,剩余能够被应用程序使用的物理内存剩10GB,即平台同时运行的虚拟机分配总内存不超过10GB(参考available值)。

图10-57 C5570V终端内存

· 若需部署使用一台License Server虚拟机,所有VOI虚拟机同时运行总内存和License Server虚拟机配置的内存大小的总值不超过10GB。

· 为了减小内存的使用,建议在一个课程镜像制作完成后关闭该课程镜像,发布完成后再进行下一个课程镜像的制作。

· C5570V作为管理平台时,暂不支持同时配置云盘和校园空间等功能。

· C5570V作为管理平台时,暂不支持配置双机热备功能。

· 小规模VOI管理服务器采用单磁盘设备(例如C108V-H、C5570V),且开局版本为E1011及之前的版本,若无法按照配置教学存储(教育场景)进行配置,可参考VOI单磁盘服务器教学镜像存储配置方法。

· VOI终端运行后,终端实际使用内存与VOI课程虚拟机所配置的内存大小无关。例如课程虚拟机配置为2GB内存,终端内存为16GB,课程在终端运行后,实际使用的内存大小为终端的16G内存,而非课程虚拟机配置的2GB。

如果交换机启动了生成树协议(默认),则需要将所有连接服务器的交换机端口配置为边缘端口。即在端口视图执行stp edged-port。

说明:缺省端口为非边缘端口

【命令】

stp edged-port命令用来配置端口为边缘端口。

undo stp edged-port命令用来恢复缺省情况。

【视图】

二层以太网接口视图

二层聚合接口视图

二层RPR逻辑接口视图

【缺省用户角色】

network-admin

mdc-admin

【使用指导】

当端口直接与用户终端相连,而没有连接到其它设备或共享网段上,则该端口被认为是边缘端口。网络拓扑变化时,边缘端口不会产生临时环路。因此,如果将某个端口配置为边缘端口,则该端口可以快速迁移到转发状态。对于直接与用户终端相连的端口,为能使其快速迁移到转发状态,请将其设置为边缘端口。

由于边缘端口不与其它设备相连,所以不会收到其它设备发过来的BPDU报文。在端口没有开启BPDU保护功能时,如果端口收到BPDU报文,即使用户设置该端口为边缘端口,该端口的实际运行状态也是非边缘端口。

在同一个端口上,不允许同时配置边缘端口和环路保护功能。

二层以太网接口视图下的配置只对当前端口生效;二层聚合接口视图下的配置只对当前接口生效;聚合成员端口上的配置,只有当成员端口退出聚合组后才能生效。

【举例】

# 配置端口GigabitEthernet1/0/1为边缘端口。

<Sysname> system-view

[Sysname] interface gigabitethernet 1/0/1

[Sysname-GigabitEthernet1/0/1] stp edged-port

lacp edge-port命令用来配置聚合接口为聚合边缘接口。

undo lacp edge-port命令用来恢复缺省情况。

【命令】

lacp edge-port

undo lacp edge-port

【缺省情况】

聚合接口不是聚合边缘接口。

【视图】

二层聚合接口视图

三层聚合接口视图

S通道聚合接口视图

【缺省用户角色】

network-admin

mdc-admin

【使用指导】

该命令主要用于在网络设备与服务器等终端设备相连的场景中。当网络设备配置了动态聚合模式,而终端设备未配置动态聚合模式时,网络设备的聚合成员端口都可以作为普通物理口转发报文,从而保证终端设备与网络设备间的多条链路可以相互备份,增加可靠性。

该配置仅在聚合接口对应的聚合组为动态聚合组时生效。

当聚合接口配置为聚合边缘接口后,聚合流量重定向功能将不能正常使用。

【举例】

# 配置二层聚合接口1为聚合边缘接口。

<Sysname> System-view

[Sysname] interface bridge-aggregation 1

[Sysname-Bridge-Aggregation1] lacp edge-port

· 仅LSI RAID卡涉及,其他厂商RAID卡不涉及。

· 未关闭上述功能,可能会影响存储性能。

· 部署存储集群前,若storcli64命令可能不可用;请在存储集群部署完成后,重新执行本小节即可。

· 更换RAID卡或升级了RAID卡驱动/Firmware,需要重新执行本操作。

(1) 执行/opt/MegaRAID/storcli/storcli64 /call set cc=off关闭consistency check功能,如下图所示。

图10-58 关闭consistency check功能

(1) 执行/opt/MegaRAID/storcli/storcli64 /call set pr=off关闭Patrol Read功能,如下图所示。

图10-59 关闭Patrol Read功能

请联系技术支持工程师获取需要的运行脚本包。

(1) 获取ls_course_storage.sh脚本。若脚本包未解压,请解压后获取.sh文件。

(2) 上传该脚本至管理节点任意目录,赋予可执行权限chmod +x ls_course_storage.sh。

(3) 根据提示输入信息(平台IP和admin密码)。

图10-60 根据提示输入信息

(4) 脚本执行成功后,登录管理平台,在[虚拟化/主机/存储]手动启动存储池。

图10-61 手动启动存储池

E1015及之后版本支持域名访问管理平台。

(1) 在域控服务器配置DNS正向解析。

图10-62 配置DNS正向解析1

图10-63 配置DNS正向解析2

图10-64 配置DNS正向解析3

(2) 执行add_domain_access.sh脚本,使域名生效。

图10-65 执行脚本使域名生效

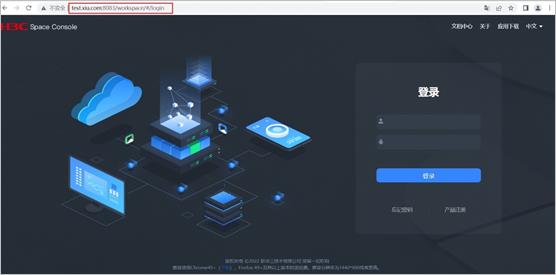

(3) 使用域名访问管理平台,可进入登录页面。

图10-66 使用域名访问管理平台

表10-5 名词解释

|

英文简称 |

说明 |

|

VDI |

虚拟桌面基础架构 |

|

IDV |

智能桌面虚拟化架构 |

|

VOI |

虚拟操作系统基础架构 |

|

VdSession |

远程桌面连接 |

|

Workspace App |

Workspace客户端软件 |